Red Hat ブログ

人工知能 (AI) は、現代の企業のビジネスのあり方を変えつつあり、組織はますます、AI と機械学習 (ML) および深層学習 (DL) 機能をクラウドネイティブ・アプリケーションに統合し、お客様や従業員により多くのインサイトと価値を提供するよう迫られています。実際、2022 年版世界のテクノロジー展望: Red Hat レポート では、今後 12 カ月で検討される可能性が最も高い新興テクノロジーのワークロードとして、調査対象の IT リーダーの 53%が AI/ML を最優先事項に位置づけていることがわかりました。

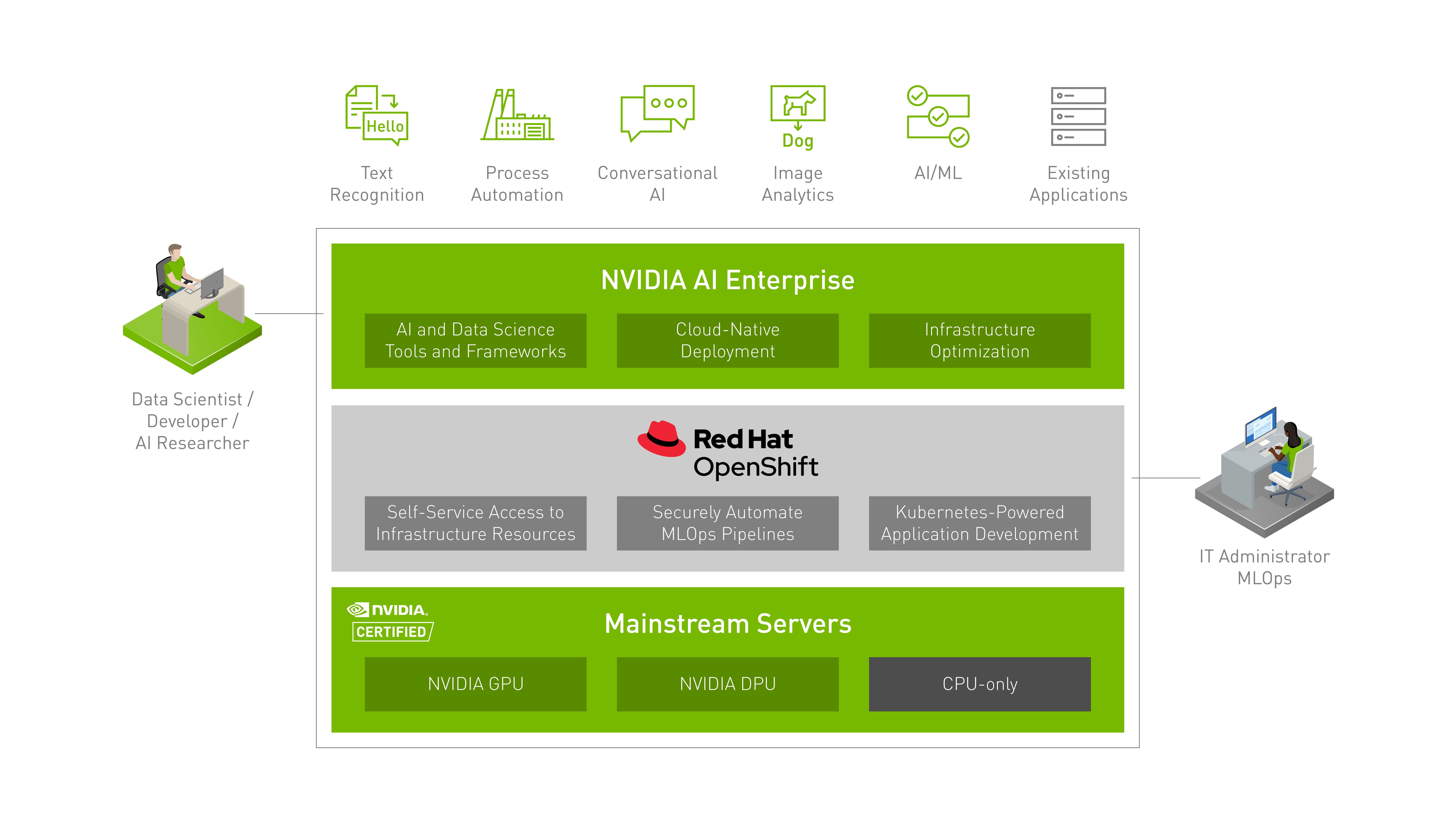

組織が AI/ML を活用したクラウドネイティブ・アプリケーションをより迅速かつ容易に開発し、それらを実稼働環境にデプロイできるように、Red Hat はいくつかの新しいインフラストラクチャーフットプリントで OpenShift をサポートしています。OpenShift は、NVIDIA DGX システムから、パブリッククラウドの Arm ベースのインスタンス、NVIDIA BlueField-2 データプロセッシングユニット (DPUs) と呼ばれる新しいクラスのデータセンター・ハードウェアにまたがる、大規模な機械学習オペレーション (MLOps) を可能にするユビキタス・インフラストラクチャを提供します。

企業は、NVIDIA LaunchPad で利用可能な NVIDIA AI Enterprise 向けに新しくキュレーションされたラボで、AI ワークロード用の Red Hat OpenShift を無料で試すことができます。

Red Hat は長年にわたり NVIDIA と提携しており、最近では、NVIDIA AI プラットフォーム上で世界クラスの AI ソリューションを開発するパートナーを支援する、新しい NVIDIA AI アクセラレーション・プログラム の戦略的メンバーとして協力しています。

このコラボレーションにより、世界中の組織のソフトウェア開発者、IT オペレーター、およびデータサイエンティストに役立つ多くの機能が生み出されました。Red Hat OpenShift のフルスタック自動化オペレーションとセルフサービス・プロビジョニングにより、アプリケーションと IT インフラストラクチャの両方において、チームはより効率的に連携し、迅速かつ安全にアイデアを開発から実稼働環境に移行することができます。

インフラストラクチャ計画の単純化からデイゼロアクティビティ、高度な AI モデルのデプロイメントまで、GPU Operator を介した NVIDIA GPUs との統合、NVIDIA NGC コンテナ のサポート、OpenShift over NVIDIA BlueField DPU を使用した Kubernetes コンテナの管理などをはじめとする OpenShift 機能は、データ分析、モデリング、推論タスクの高速化およびネットワークの保護に役立ちます。

OpenShift の DevOps および GitOps の自動化機能を AI ライフサイクル全体に導入することで、MLOps を実現し、データサイエンティスト、ML エンジニア、ソフトウェア開発者と IT オペレーション間のより優れたコラボレーションを可能にします。MLOps は、予測精度を維持するために、ソフトウェア開発プロセスへのモデルの統合、製品のロールアウト、モニタリング、再トレーニング、再デプロイメントの反復プロセスを自動化および単純化することを可能にします。

本日は、MLOps の実現に向けた大きな前進について発表しています。つまり、Red Hat OpenShift と NVIDIA AI Enterprise ソフトウェアスイートを組み合わせ、AI を活用した新しいインテリジェント・アプリケーションの開発、デプロイメント、および管理を加速して効率化することで、これを実現します。

NVIDIA AI Enterprise での Red Hat OpenShift の認定

Red Hat OpenShift は、NVIDIA の AI ツールおよびフレームワークの包括的なポートフォリオである NVIDIA AI Enterprise 2.0 で、認定およびサポートされるようになりました。業界をリードするエンタープライズ Kubernetes プラットフォームである Red Hat OpenShift と、NVIDIA 認定システムで実行される NVIDIA AI Enterprise ソフトウェアスイートを組み合わたことで、ヘルスケアから金融サービスや製造業などの業界にまたがって、DL および ML を含むさまざまな AI ユースケースを加速させるスケーラブルな AI プラットフォームを提供します。

このソリューションには、AI を活用したクラウドネイティブアプリケーションをより安全に開発、デプロイ、管理、スケーリングするための、NVIDIA と Red Hat の主要なテクノロジーとサポートが含まれています。Red Hat と NVIDIA の両社から認定を受けたサーバーシステムで利用でき、それらのサーバー上で VMware vSphere などの仮想化プラットフォームが動作するこのソリューションにより、お客様はハイブリッドクラウド環境全体、ベアメタル環境または仮想化環境で、AI ワークロードを一貫してデプロイすることが可能になります。

この包括的なサービスにより、デプロイメントのリスクが回避され、シームレスな運用スケーリングが可能となります。これは、データサイエンティストが製品のロールアウト前に、AI モデルを迅速に構築して共有するための、セルフサービス・エクスペリエンスを提供します。さらに、Red Hat OpenShift の統合された DevOps 機能により、MLOps は AI を活用したアプリケーションの継続的デリバリーを迅速化することができます。

Red Hat OpenShift を使用した NVIDIA AI Enterprise では、開発者が AI を活用したクラウドネイティブ・アプリケーションと高性能データ分析を構築できる速度を加速する AI ツールとフレームワークの包括的な選択肢を組織に提供します。このソリューションにより、組織は既存のインフラストラクチャ上で最新のクラウドネイティブなワークロードをスケーリングできるようになるとともに、エンタープライズクラスの管理の容易性、セキュリティー機能、および可用性を実現することが可能になります。

また、Kubernetes プラットフォームでアクセラレーションされた AI/ML インフラストラクチャーの必要性を評価しているものの、AI とデータ・サイエンス・ワークロード用のリソースを構成、最適化、調整するハンズオンのラボ体験を希望する企業のために、Red Hat および NVIDIA は、NVIDIA LaunchPad で OpenShift を利用できるようにしました。

NVIDIA のこのプライベートな GPU アクセラレーションによるコンピュート・インフラストラクチャにより、お客様は、後でアクセスまたは取得できるものと同じハードウェアおよびソフトウェア設定を使用して、IT プロフェッショナル向けの無料ラボで OpenShift の使用を体験することができます。LaunchPad インフラストラクチャで Red Hat OpenShift を利用できることで、お客様は、予算を費やすことなく、Kubernetes および DevOps を活用するアクセラレーションされた AI/ML インフラストラクチャ・ドメインを評価および検討することができます。また、実稼働環境で予想される内容のプレビューも提供されます。

このインフラストラクチャーが提供する使いやすさ、自動化、最新の GPU アクセラレーターへのアクセスを享受しながら、NVIDIA LaunchPad で Red Hat OpenShift と NVIDIA AI Enterprise を体験していただくことをお勧めします。

その他のリソース

- プレスリリース を読む

- Red Hat と NVIDIA のパートナーシップ の詳細について

- Red Hat OpenShift の詳細について

- OpenShift における AI/ML の詳細について

- Red Hat Openshift での MLOps の詳細について

- NVIDIA Launchpad で OpenShift を試してみる

執筆者紹介

Yan Fisher is a Global evangelist at Red Hat where he extends his expertise in enterprise computing to emerging areas that Red Hat is exploring.