-

제품 및 도큐멘테이션 Red Hat AI

하이브리드 클라우드 전반에서 AI를 개발하고 배포하기 위한 제품 및 서비스의 플랫폼입니다.

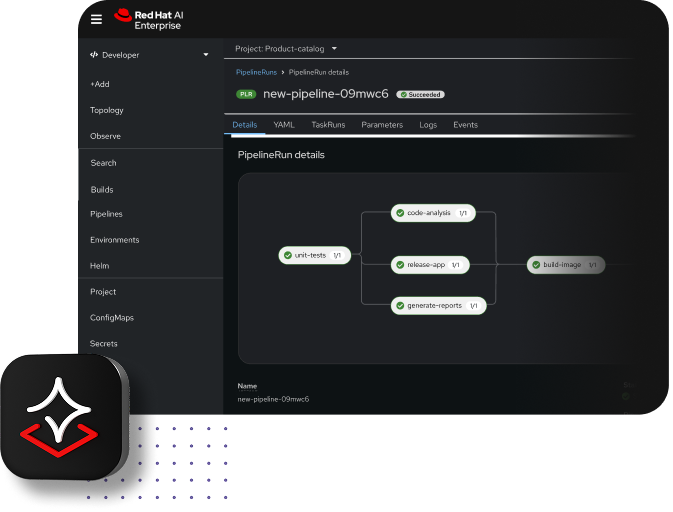

Red Hat AI Enterprise

하이브리드 클라우드 전반에서 AI 기반 애플리케이션을 빌드, 개발, 배포합니다.

-

학습 기본 사항

-

AI 파트너

Red Hat AI

하이브리드 클라우드 전반에서 기반 하드웨어 가속기에 상관없이 실행되는 모든 모델과 에이전트를 지원하는 신뢰할 수 있는 기반을 통해 엔터프라이즈 AI 솔루션의 개발과 배포를 가속화하세요.

Red Hat AI는 최신 릴리스를 통해 에이전트의 유연성과 효율성을 확장합니다.

Red Hat AI 3.4 출시

준비된 플랫폼에서 에이전틱(Agentic) AI 제공

에이전틱(Agentic) AI를 통해 AI 경험은 대화에서 자율 실행으로 진화합니다.

Red Hat® AI는 BYOA(Bring Your Own Agent) 방식으로 엔터프라이즈에서 요구하는 거버넌스 및 제어를 포함하여 에이전트를 배포할 수 있도록 지원합니다.

Red Hat AI에 대한 ROI(투자 수익률) 233%

Red Hat의 의뢰로 수행한 Forrester Consulting 연구에 따르면, 현재 Red Hat AI 고객을 기반으로 한 복합적인 조직이 Red Hat AI를 배포하여 ROI(투자 수익률) 233%를 실현한 것으로 나타났습니다.1

Red Hat AI를 선택하는 이유

하이브리드 클라우드 전반에서 기반 하드웨어 가속기에 상관없이 모든 모델과 에이전트를 지원하는 신뢰할 수 있는 기반에서 구축하세요. Red Hat AI는 조직이 데이터, 컴플라이언스, 비용 요구 사항에 따라 자유롭게 배포할 수 있도록 지원합니다.

추론

vLLM 기반의 빠르고 효율적인 추론과 하이브리드 클라우드 전반에서 기반 가속기에 상관없이 모든 모델을 실행할 수 있는 제어 기능으로 모델 복잡성을 관리하세요.

데이터

조직의 자체 프라이빗 데이터에 연결된 모델을 사용하여 도메인별 에이전틱(Agentic) AI 활용 사례를 사용자 정의할 수 있습니다.

에이전트

거버넌스와 제어를 통해 성공적인 에이전틱(Agentic) AI 도입 여정을 간소화하고 가속화하세요.

플랫폼

오픈소스 투명성과 하이브리드 클라우드 확장성을 기반으로 복원력이 뛰어난 신뢰할 수 있는 AI 솔루션을 배포하세요.

Red Hat AI의 기능

하이브리드 클라우드 전반에서 AI를 확장하는 데 필요한 유연성과 일관성을 위해 Red Hat AI에는 통합 제품 포트폴리오가 포함되어 있습니다.

하이브리드 클라우드 전반에서 AI 구축, 개발, 배포

Red Hat AI Enterprise는 엔터프라이즈급 기능을 갖춘 즉시 사용 가능한 개발 환경입니다. AI 모델과 애플리케이션 라이프사이클을 통합하여 효율성을 높이고 제공 속도를 향상하며 리스크를 완화합니다.

규모에 따른 일관되고 신속하며 비용 효율적인 추론

vLLM 및 llm-d와 같은 오픈소스 기술을 기반으로 하는 Red Hat AI Inference는 원하는 모델과 가속기를 사용하여 하이브리드 클라우드 전반에서 유연하게 확장할 수 있도록 지원합니다.

머신 러닝 모델 학습, 튜닝, 배포, 모니터링

Red Hat OpenShift®의 기능을 기반으로 구축된 Red Hat OpenShift AI는 하이브리드 클라우드 환경 전반에서 예측 AI 모델과 생성형 AI 모델의 라이프사이클을 규모에 맞게 관리하기 위한 AI 플랫폼입니다.

개별 서버 환경에서 AI 모델 실행 및 최적화

Red Hat Enterprise Linux® AI는 개별 서버 환경에서 대규모 언어 모델(LLM)을 실행하기 위한 플랫폼입니다.

항공 산업에서 경쟁 우위 확보

Turkish Airlines는 Red Hat AI를 통해 비즈니스 전반에서 60개 이상의 모델을 프로덕션에 적용할 수 있었습니다.

Hitachi는 AI를 비즈니스 전체에 도입하여 운영하고 있습니다.

데니즈뱅크(Denizbank)는 시장 출시 시간을 일 단위에서 분 단위로 단축했습니다.

JCCM은 AI를 통해 지역 내 환경 영향 평가(EIA) 프로세스를 개선했습니다.

Red Hat AI Factory with NVIDIA

Red Hat AI Factory with NVIDIA는 Red Hat AI Enterprise의 통합 AI 플랫폼 기능을 NVIDIA의 가속화된 컴퓨팅, 네트워킹, NVIDIA AI Enterprise 소프트웨어와 결합합니다. 이 공동 엔지니어링 솔루션을 통해 팀은 엔터프라이즈급 신뢰성과 효율성으로 프로덕션 모델을 커스터마이징, 관리, 확장할 수 있습니다.

다양한 AI 파트너를 통한 다양한 발전 경로

고객이 AI를 더욱 다양하게 활용할 수 있도록 전문가와 기술을 함께 제공합니다. 다양한 기술 파트너들이 Red Hat과 협력하여 솔루션의 상호 운용성을 인증하고 있습니다.

Red Hat Summit과 AnsibleFest의 2025 AI 고객 사례

터키항공(Turkish Airlines)은 전사적 데이터 액세스를 실현하여 배포 속도를 두 배로 높였습니다.

JCCM은 AI를 통해 지역 내 환경 영향 평가(EIA) 프로세스를 개선했습니다.

데니즈뱅크(Denizbank)는 시장 출시 시간을 일 단위에서 분 단위로 단축했습니다.

히타치(Hitachi)는 Red Hat OpenShift AI를 통해 AI를 비즈니스 전체에 도입하여 운영하고 있습니다.

신뢰할 수 있는 기반 위에 구축

하이브리드 클라우드 인프라, 애플리케이션 서비스, 클라우드 네이티브 애플리케이션 개발, 자동화 솔루션으로 구성된 Red Hat의 폭넓은 포트폴리오를 신뢰하는 전 세계 기업을 위해 어떤 인프라에서도 IT 서비스를 빠르고 비용 효율적으로 제공합니다.

더 많은 AI 리소스 살펴보기

기업에서 AI를 시작하는 방법

AI를 위한 Red Hat Consulting

Red Hat Consulting: AI 플랫폼 기반

Red Hat AI에 대해 Red Hatter에게 문의하기

1Forrester Consulting 연구, Red Hat 의뢰. “Red Hat AI의 Forrester Total Economic Impact™." 2026년 2월.