-

Productos y documentación Red Hat AI

Una plataforma de productos y servicios para el desarrollo y la implementación de la inteligencia artificial en la nube híbrida.

Red Hat AI Enterprise

Diseña, desarrolla e implementa aplicaciones impulsadas por la inteligencia artificial en la nube híbrida.

Red Hat AI Inference Server

Optimiza el rendimiento de los modelos con vLLM para realizar inferencias rápidas y rentables según sea necesario.

Red Hat Enterprise Linux AI

Desarrolla, prueba y ejecuta modelos de inteligencia artificial generativa con funciones de inferencia optimizadas.

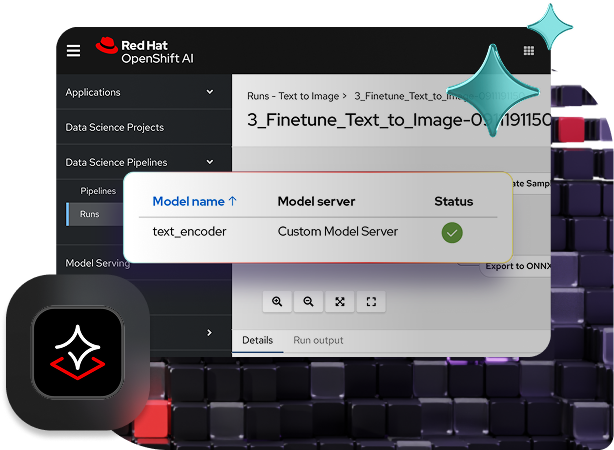

Red Hat OpenShift AI

Diseña e implementa aplicaciones y modelos con inteligencia artificial según sea necesario en entornos híbridos.

-

Recursos de aprendizaje Conceptos básicos

- Novedades de Red Hat AI

- Why you should care about AI inference

- ¿Qué son los vLLM?

- ¿Qué es la inferencia de la inteligencia artificial?

- La IA predictiva y la IA generativa

- ¿Qué es la IA con agentes?

- Mira el video RAG vs. fine-tuning

- Más información sobre la inteligencia artificial

- Todas las publicaciones de blog sobre inteligencia artificial

Casos prácticos de los productos

-

Partners de IA

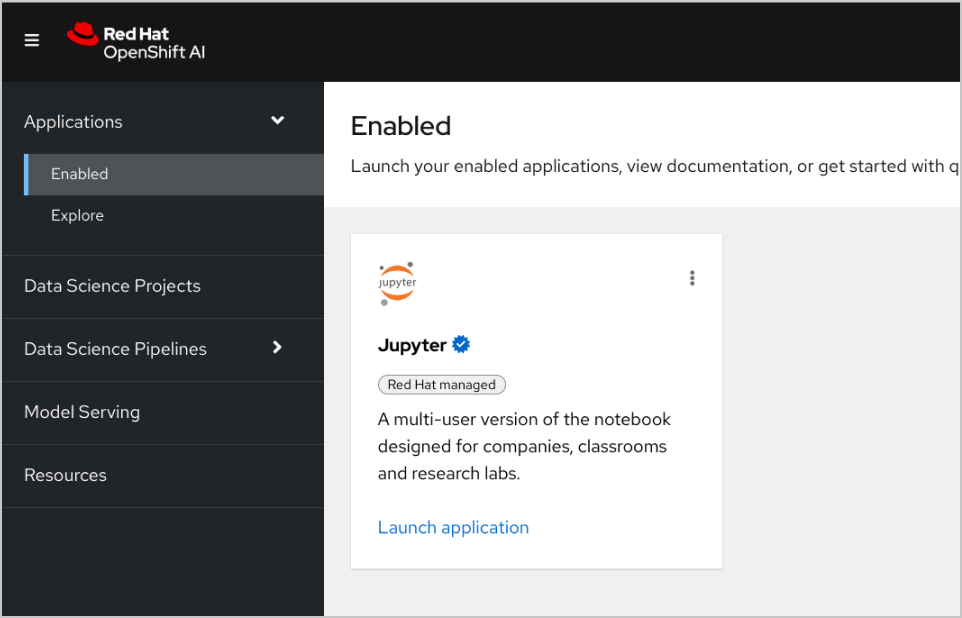

Red Hat OpenShift AI

Red Hat® OpenShift® AI es una plataforma para gestionar el ciclo de vida de los modelos de inteligencia artificial predictiva y generativa según sea necesario en los entornos de nube híbrida.

¿Qué es Red Hat OpenShift AI?

Está diseñada con tecnologías de open source y proporciona funciones confiables y uniformes en términos operativos para que los equipos realicen pruebas, pongan los modelos a disposición de los usuarios y distribuyan aplicaciones innovadoras.

OpenShift AI permite la recopilación y la preparación de los datos; el entrenamiento, el ajuste, la distribución y la supervisión de los modelos; y la aceleración del hardware. Gracias al ecosistema abierto de partners de hardware y software, la plataforma brinda la flexibilidad necesaria para tu caso práctico específico.

Agiliza el traslado de las aplicaciones con inteligencia artificial a la etapa de producción

Combina las funciones probadas de Red Hat OpenShift AI y Red Hat OpenShift en una única plataforma de aplicaciones de inteligencia artificial lista para las empresas que reúne a todos los equipos. De esta forma, los analistas de datos, los ingenieros y los desarrolladores de aplicaciones podrán colaborar en una única ubicación y, así, fomentar la uniformidad, el enfoque en la seguridad y la capacidad de ajuste.

La última versión de OpenShift AI incluye una colección cuidadosamente seleccionada de modelos de terceros optimizados, listos para el entorno de producción y validados para Red Hat OpenShift AI. Si tu equipo accede a este catálogo de modelos de terceros, podrá controlar mejor quién puede acceder a los modelos y visualizarlos para cumplir sus requisitos en torno a la seguridad y las políticas.

Además, OpenShift AI permite gestionar los costos de las inferencias con servidores distribuidos a través de un marco de vLLM optimizado. Para simplificar aún más las operaciones, ofrece herramientas avanzadas que permiten automatizar las implementaciones y el acceso de autoservicio a los modelos, las herramientas y los recursos.

Características y ventajas

Menos tiempo para la gestión de la infraestructura de la IA

Accede cuando quieras a modelos con muy buen rendimiento que facilitan el autoservicio, el ajuste y la distribución. Los desarrolladores pueden ahorrarse las complicaciones, mantener el control y optimizar los costos.

En este momento, funciones tales como el modelo como servicio (MaaS) se encuentran en la versión de prueba para desarrolladores. Ofrece una estrategia para acceder a la inteligencia artificial que involucra extremos de API. Gracias a ella, la inteligencia artificial funciona más rápido y de forma privada sin importar su dimensión.

Herramientas de inteligencia artificial/machine learning probadas y compatibles

Red Hat se encarga de las pruebas, la integración y el soporte de las herramientas de inteligencia artificial/machine learning y la distribución de modelos por ti. OpenShift AI se basa en los años de preparación de nuestro proyecto comunitario Open Data Hub y de proyectos open source como Kubeflow.

Gracias a nuestra experiencia y conocimiento en tecnología de open source, podemos establecer las bases para implementar inteligencia artificial generativa de manera que los clientes tengan más opciones y puedan confiar más en sus estrategias para esta tecnología.

Flexibilidad en la nube híbrida

Red Hat OpenShift AI ofrece una plataforma segura y flexible que te permite elegir dónde desarrollar e implementar tus modelos, ya sea en las instalaciones, en la nube pública o en el extremo de la red.

Utiliza nuestras prácticas recomendadas

Con Red Hat Services, obtienes experiencia, capacitaciones y soporte que te permiten superar los desafíos de la inteligencia artificial, sin importar cómo vayas con tu proceso de adopción de la inteligencia artificial.

Ya sea que quieras crear un prototipo de una solución de inteligencia artificial, agilizar la implementación de tu plataforma de inteligencia artificial o promover tus estrategias de operaciones de machine learning (MLOps), Red Hat Consulting ofrece el soporte y las mentorías que necesitas.

Guías de inicio rápido sobre la IA

Explora una variedad de casos prácticos innovadores de inteligencia artificial de nuestra comunidad. Estos ejemplos sencillos y específicos se diseñaron para una implementación rápida y sencilla en la plataforma Red Hat AI.

El marco llm-d ofrece opciones claras para los desarrolladores

Red Hat OpenShift AI incluye llm-d, un marco open source que resuelve los desafíos de la inferencia de la inteligencia artificial distribuida a gran escala.

Ampliar los modelos en una flota de GPU distribuidas aporta un nuevo nivel de control y observación. Al dividir el canal de inferencia en servicios inteligentes y modulares, las empresas pueden optimizar modelos de lenguaje de gran tamaño (LLM) complejos según sea necesario.

Los servidores de MCP para Red Hat OpenShift AI

Analiza la colección cuidadosamente seleccionada de servidores de MCP de partners tecnológicos que integran Red Hat OpenShift AI.

El protocolo de contexto de modelos (MCP) es un protocolo open source que permite la conexión bidireccional y la comunicación estandarizada entre las aplicaciones de inteligencia artificial y los servicios externos.

Ahora puedes aprovechar estos servidores de MCP para integrar herramientas y recursos empresariales en tus aplicaciones de inteligencia artificial y flujos de trabajo con agentes.

Optimiza tus recursos con vLLM para realizar inferencias rápidas y rentables según sea necesario.

Red Hat AI Inference Server forma parte de la plataforma de Red Hat AI. Está disponible como un producto independiente y se incluye en Red Hat Enterprise Linux® AI y en Red Hat OpenShift® AI.

La inteligencia artificial que se adapta a tus necesidades y opera según tus condiciones.

Inteligencia artificial generativa

Produce contenido nuevo, como texto y código de software.

Red Hat AI te permite ejecutar los modelos de inteligencia artificial generativa que elijas con mayor rapidez, menos recursos y menos costos de inferencia.

Inteligencia artificial predictiva

Conecta patrones y prevé resultados futuros

Con Red Hat AI, las empresas pueden diseñar, entrenar, poner a disposición y supervisar los modelos predictivos, mientras mantienen la uniformidad en toda la nube híbrida.

El uso de la inteligencia artificial

Crea sistemas que respalden el mantenimiento y la implementación de la inteligencia artificial a gran escala.

Con Red Hat AI, puedes gestionar y supervisar el ciclo de vida de las aplicaciones que utilizan la inteligencia artificial, ahorrar recursos y garantizar el cumplimiento de las normas de privacidad.

Inteligencia artificial con agentes

Diseña flujos de trabajo que lleven a cabo tareas complejas con supervisión limitada.

Red Hat AI ofrece un enfoque flexible y una base estable para diseñar, gestionar e implementar flujos de trabajo de inteligencia artificial con agentes dentro de las aplicaciones actuales.

Partners

Utiliza Red Hat OpenShift AI con otros servicios y productos integrados para potenciar el rendimiento de la plataforma.

NVIDIA y Red Hat brindan a sus clientes una plataforma con capacidad de ajuste que acelera una amplia variedad de casos prácticos de inteligencia artificial con una flexibilidad incomparable.

Intel® y Red Hat ayudan a las empresas a agilizar la adopción de la inteligencia artificial y el uso de los modelos de inteligencia artificial/machine learning.

IBM y Red Hat facilitan innovaciones open source para acelerar el desarrollo de la inteligencia artificial, como IBM watsonx.aiTM, un estudio de inteligencia artificial listo para las empresas y destinado a los desarrolladores de esa tecnología.

Starburst Enterprise y Red Hat permiten obtener información más precisa y actualizada mediante el análisis rápido de los datos en varias plataformas distribuidas y dispares.

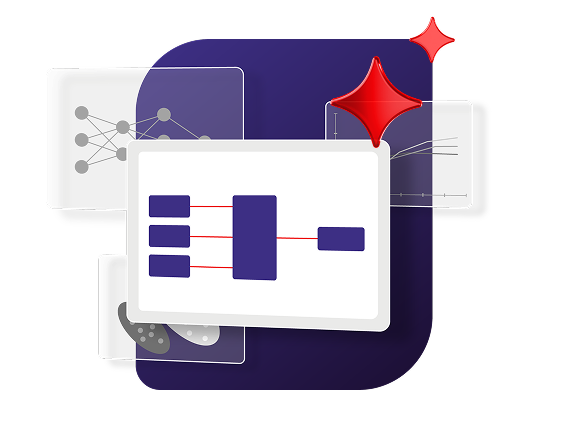

Colaboración en entornos de trabajo para modelos

El centro de inteligencia artificial y el estudio de inteligencia artificial generativa permiten que los ingenieros de plataforma y los de inteligencia artificial trabajen en conjunto para trasladar los modelos de inteligencia artificial generativa a los entornos de producción en menos tiempo.

Con los centros de inteligencia artificial, los ingenieros de plataforma pueden gestionar los LLM con cargas de trabajo de inteligencia artificial concentradas junto con estadísticas sobre rendimiento de la validación de modelos de terceros. Con el estudio de inteligencia artificial generativa, los ingenieros cuentan con un entorno práctico para interactuar con los modelos y generar prototipos de aplicaciones de inteligencia artificial generativa rápidamente en el entorno de prueba. Verifica que el modelo sea adecuado para tu caso antes de integrarlo accediendo a un entorno de pruebas (sandbox) para experimentar con los flujos de generación aumentada por recuperación (RAG) y chat.

Además, los analistas de datos pueden acceder a imágenes de clústeres personalizadas o ya compiladas para trabajar con modelos que usan los marcos o los entornos de desarrollo integrados que prefieras. Red Hat OpenShift AI realiza un seguimiento de los cambios en Jupyter, PyTorch, Kubeflow y otras tecnologías de open source de inteligencia artificial.

Adapta la seguridad y la distribución de los modelos con Red Hat OpenShift AI

Los modelos se pueden poner a disposición de los usuarios con una versión optimizada de vLLM (u otros servidores de modelos de tu elección) para integrarlos a aplicaciones que funcionan con inteligencia artificial en las instalaciones, la nube pública o el extremo de la red. Además, pueden volver a diseñarse e implementarse y se controlan según los cambios en el notebook fuente.

Las alucinaciones y el sesgo pueden poner en peligro la integridad de los modelos y dificultar su ajuste. Para mantener la imparcialidad, la seguridad y la capacidad de ajuste, OpenShift AI permite que los especialistas en datos supervisen la alineación entre los resultados del modelo y los datos de entrenamiento.

Con las herramientas de detección de deriva, se puede captar cuando los datos activos usados para la inferencia de los modelos se desvían de los datos de entrenamiento originales. Las medidas de seguridad para inteligencia artificial también se incluyen para proteger tus modelos contra el ingreso y la generación de información maliciosa, como lenguaje abusivo y vulgar, datos personales y otras restricciones específicas del área.

Historias de clientes sobre inteligencia artificial en Red Hat Summit y AnsibleFest 2025

Turkish Airlines duplicó la velocidad de la implementación al brindar acceso a los datos en toda la empresa.

JCCM mejoró los procesos de evaluación del impacto ambiental (EIA) de la región con la inteligencia artificial.

DenizBank agilizó el tiempo de comercialización de días a minutos.

Hitachi implementó la inteligencia artificial en toda su empresa con Red Hat OpenShift AI.

Prueba de Red Hat OpenShift AI

Entorno de pruebas (sandbox) para desarrolladores

Está destinado a desarrolladores y analistas de datos que deseen probar el diseño de aplicaciones con inteligencia artificial en un entorno flexible y configurado previamente.

Versión de prueba de 60 días

Cuando tu empresa esté lista para evaluar todas las funciones de OpenShift AI, accede a la versión de prueba del producto de 60 días. Debes poseer un clúster de Red Hat OpenShift para hacerlo.