À medida que a IA se torna um motor da competitividade nacional, o conceito de IA soberana (a capacidade de operar sistemas de IA livres de influência externa) se torna cada vez mais relevante. No entanto, o caminho para a adoção está repleto de desafios. Uma pesquisa recente com mais de 900 líderes de TI e engenheiros de IA sobre a adoção de IA expõe uma "lacuna de valor" significativa. A pesquisa demonstra que, apesar de grande entusiasmo (72%), apenas 7% das organizações da Europa, Oriente Médio e África (EMEA) estão apresentando resultados.

A pesquisa destaca que os silos de infraestrutura e privacidade de dados estão paralisando os esforços de desenvolvimento de IA. Como resultado, a IA soberana passou rapidamente de um "desafio da nuvem" teórico para uma necessidade prática. Ao mitigar os riscos específicos identificados na pesquisa da Red Hat, a IA soberana permite que empresas regulamentadas passem com confiança da fase piloto para a produção sem comprometer:

- Conformidade regulatória: adesão a regulamentações rígidas, como o Regulamento Geral sobre a Proteção de Dados (GDPR), o EU AI Act e as leis de residência de dados, que exigem que os dados de cidadãos permaneçam dentro de limites específicos.

- Resiliência operacional: a capacidade de dar continuidade às operações durante a instabilidade geopolítica ou a desconexão da internet global.

- Autonomia estratégica: as organizações evitam a dependência de fornecedores e mantêm controle total sobre a propriedade intelectual, como modelos e pesos, gerada a partir de dados confidenciais.

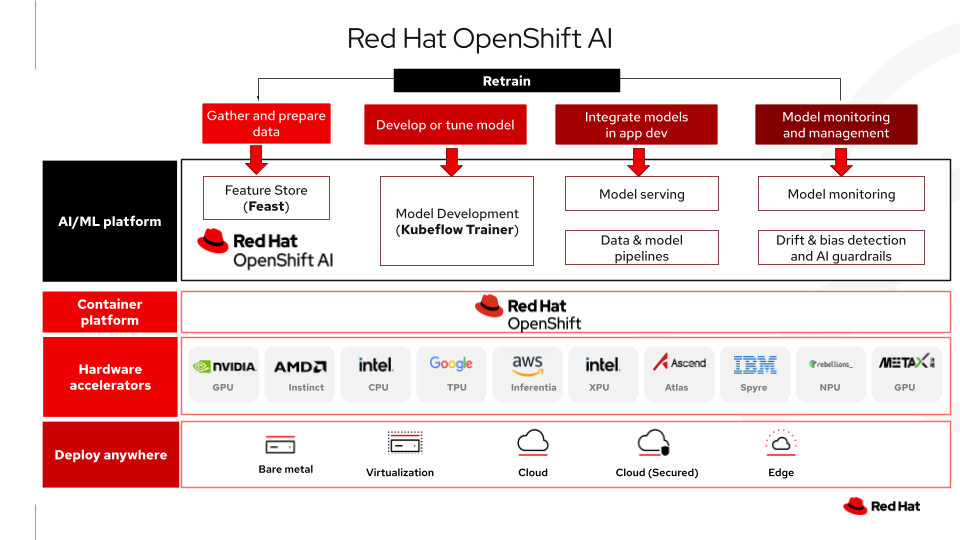

O Red Hat OpenShift AI oferece a base para essa soberania, permitindo que as organizações criem uma fábrica de IA isolada e, ao mesmo tempo, mantenham controle absoluto sobre a segurança, os dados, os modelos e os resultados.

Neste artigo, analisamos exemplos específicos de desafios de IA soberana que nossos clientes estão enfrentando, abstraímos os principais temas que precisam ser abordados e propomos uma solução para esses problemas.

Caso de uso: o dilema da "independência da IA"

O protagonista: Dr. Aris (uma persona composta baseada em desafios reais de clientes), Group Manager do Ministério da Saúde em um país europeu de médio porte.

O desafio: o Ministério possui uma "mina de ouro" de dados: décadas de registros anônimos de pacientes, sequências genômicas e histórico epidemiológico local. Dr. Aris quer criar um "LLM do National Health" para auxiliar os médicos a diagnosticar doenças raras específicas da população.

O Ministério está enfrentando um problema crucial de "shadow AI". Pesquisadores frustrados estão enviando secretamente snippets anônimos para LLMs públicos para trabalhar, correndo o risco de vazamento de dados. Eles precisam de uma plataforma interna sancionada, totalmente segura e tão fácil de usar quanto a nuvem pública.

O conflito:

- A armadilha da nuvem: os principais provedores de IA que oferecem Modelos como Serviço (MaaS) exigem o upload de dados confidenciais para nuvens públicas nos EUA. Isso pode violar o Regulamento Geral sobre a Proteção de Dados (GDPR), as leis de residência de dados e os protocolos de segurança nacional.

- O pesadelo do "DIY (faça você mesmo)": Dr. Aris tenta criar a plataforma do zero. Sua equipe fica rapidamente paralisada pelo caos operacional de arbitrar o acesso ao cluster de 500 GPUs, resultando em uma contenção constante de recursos. Experimentos críticos esperam indefinidamente, enquanto o hardware reservado fica ocioso.

A solução: o Ministério cria uma plataforma de IA soberana com base no OpenShift AI, também usando o Kubeflow e o Feast.

- A mudança: em vez de depender de APIs de nuvem proprietárias, o time do Dr. Aris cria sua própria "fábrica de modelos", com uma infraestrutura protegida e isolada. O OpenShift AI, que inclui componentes do Kubeflow, abstrai o hardware do cluster de GPU, permitindo que a equipe treine modelos enormes sem enviar um único byte para o exterior. O Feast ajuda a centralizar o gerenciamento de recursos no treinamento e na inferência, para que os recursos que alimentam os modelos sejam definidos de forma consistente, permitindo a governança e a rastreabilidade.

- O resultado: basta um cientista de dados enviar uma solicitação de treinamento para o sistema iniciar automaticamente um cluster distribuído, recuperar funcionalidades do Feast, treinar o modelo e finalizá-lo, tudo isso feito no data center nacional isolado. Dr. Aris alcança a "autonomia da IA" usando uma plataforma de IA escalável e desconectada nos termos de seu país.

Três pilares da IA soberana

Para passar de uma "colônia digital" (uma nação (ou comunidade) que depende tão fortemente da infraestrutura de tecnologia estrangeira que perde o controle sobre sua própria economia digital, dados e desenvolvimento futuro) para "soberania digital", uma nação deve controlar três camadas principais do stack de tecnologia de IA.

Soberania técnica (a base)

Princípio: a soberania exige uma cadeia de custódia transparente e resiliência contra o uso da cadeia de suprimentos como arma. Ao adotar uma camada de plataforma independente de hardware, os países podem otimizar seu progresso em IA por meio de uma estratégia multifornecedor. Assim, a autonomia estratégica é preservada, independentemente das mudanças na cadeia de suprimentos global. A plataforma soberana deve separar o software do hardware e combinar a propriedade estrita da infraestrutura com a flexibilidade de se adaptar à disponibilidade do mercado. Ao aderir aos padrões open source, os recursos de IA de uma organização podem ser inspecionados, auditados e mantidos independentemente do roadmap ou do monopólio de hardware de qualquer fornecedor. Desse modo, a autoridade absoluta sobre a continuidade do serviço é mantida.

Validação: a pesquisa da Red Hat sobre IA confirma que 92% dos líderes de TI consideram o open source empresarial essencial para sua estratégia de IA. Ele oferece a consistência e a transparência necessárias para controlar a cadeia de suprimentos de IA.

Soberania dos dados (o ativo)

Princípio: a gravidade dos dados é absoluta. Os dados confidenciais devem residir em mídias de armazenamento localizadas fisicamente no perímetro soberano e sujeitas apenas às leis locais. O desafio é oferecer aos cientistas de dados a facilidade de seleção e recuperação de dados encontrada na nuvem, restringindo, ao mesmo tempo, fisicamente a movimentação de dados a uma rede interna segura.

Soberania operacional (o controle)

Princípio: o "control plane" deve ser local. Os fluxos de trabalho críticos não podem depender de um console de software como serviço (SaaS) hospedado em outro continente para gerenciar recursos de computação ou dados de acesso de usuários. Uma plataforma soberana exige um control plane independente que lide com o gerenciamento de identidade e acesso (IAM) e a orquestração de recursos totalmente no perímetro local.

Solução técnica

Nossa solução é baseada em uma arquitetura em camadas, na qual o Red Hat AI atua como uma plataforma soberana unificadora, orquestrando os recursos de treinamento do Kubeflow e o gerenciamento de dados do Feast.

Essa solução é baseada em padrões open source, especificamente no Red Hat OpenShift, que fornece a base Kubernetes, e no projeto Kubeflow. Ao usar os componentes incluídos (Model Registry, KServe, Pipeline and Training e Feast para disponibilização de recursos), as organizações podem manter a propriedade total de seu stack de tecnologia. Essa transparência permite a inspeção do código em busca de vulnerabilidades e contribui diretamente com o roadmap do projeto. Nosso foco aqui é como o Kubeflow Training e o Feast oferecem suporte a esses requisitos de soberania.

Red Hat AI: o blueprint aberto para a soberania de IA

Para alcançar a verdadeira soberania, a plataforma subjacente precisa ser tão confiável quanto os dados que processa. O Red Hat AI oferece uma base empresarial robusta que atende às necessidades específicas de fábricas de IA protegidas e independentes.

O Red Hat AI oferece total independência de infraestrutura. Ele oferece suporte à implementação em bare metal isolado, nuvens privadas ou parceiros de nuvem soberana confiáveis. Isso permite que uma organização escolha seus próprios fornecedores de hardware (por exemplo, NVIDIA, Intel, AMD) e mantenha autoridade absoluta sobre a continuidade do serviço.

- Cadeia de suprimentos de software confiável: a soberania começa na fonte. O Red Hat AI oferece um catálogo de ferramentas de IA certificadas, verificadas quanto a vulnerabilidades e com assinatura digital. Assim, o software executado dentro do seu perímetro isolado está livre de vulnerabilidades conhecidas, um requisito essencial para a segurança nacional.

- Control plane de MLOps unificado: a plataforma consolida o stack de tecnologia de IA fragmentado em uma única interface. Ele ajuda a gerenciar as dependências complexas entre o sistema operacional (Red Hat Enterprise Linux), o hardware (GPUs) e a camada da aplicação (Kubeflow/Feast). Assim, os cientistas de dados podem se concentrar na modelagem, e não na parte hidráulica da infraestrutura.

- Abstração de hardware escalável: seja executado em racks bare-metal ou em uma nuvem privada virtualizada, o Red Hat AI abstrai os recursos físicos. Ele usa operadores para ajustar e expor automaticamente hardware especializado, como as GPUs em um supercomputador nacional, habilitando a multitenancy forte sem expor a complexidade ao usuário.

Com essa base segura estabelecida, passamos a contar com o Red Hat OpenShift AI. Como uma plataforma de IA distribuída do portfólio do Red Hat AI, o OpenShift AI permite que as organizações criem, ajustem, implementem e gerenciem modelos e aplicações de IA. Ele atua como um sistema nervoso central que orquestra três recursos integrados essenciais: um mecanismo de treinamento de alto desempenho, uma camada de gerenciamento de dados preciso e uma estrutura de disponibilização de modelos otimizada.

Computação integrada: Kubeflow Trainer

Para uma fábrica de IA soberana, confiar na infraestrutura de nuvem pública geralmente não é uma opção, devido aos rigorosos requisitos de controle e residência de dados. Para manter a verdadeira soberania, você deve possuir e operar o hardware. No entanto, essa independência inclui a responsabilidade de gerenciá-la com eficiência, incluindo a programação de tarefas complexas distribuídas, o gerenciamento de falhas de nós e o uso eficiente de ativos de supercomputação de alto valor.

O Kubeflow Training (um componente do OpenShift AI) resolve esse paradoxo operacional. Ele traz a facilidade de uso nativa em nuvem para sua infraestrutura privada, atuando como o mecanismo de alto desempenho que simplifica o treinamento distribuído no Kubernetes. Ele substitui fluxos de trabalho fragmentados pela API TrainJob unificada, permitindo que os cientistas de dados escalem frameworks, como PyTorch e TensorFlow, sem precisar reescrever códigos de infraestrutura complexos.

- Simplificação: ao abstrair a infraestrutura soberana subjacente, o sistema oferece uma interface única e consistente para tarefas de treinamento distribuídas em grande escala.

- Confiabilidade: baseado na API JobSet do Kubernetes, o sistema garante que todo o grupo seja gerenciado corretamente (agendamento do tipo "tudo ou nada") se um nó em um cluster de treinamento distribuído falhar. Isso ajuda a reduzir o desperdício de recursos, pois as tarefas de treinamento em grande escala são executadas por completo ou reiniciadas de forma limpa.

- Integração: o sistema tem integração nativa com o Kueue (parte do stack de agendamento do OpenShift AI) para gerenciar cotas e filas de tarefas, alocando dinamicamente os recursos da GPU a partir do pool de nós subjacente do OpenShift, para que os ativos de computação nacionais sejam usados com mais eficiência.

Dados soberanos: Feast Feature Store

Embora a verdadeira soberania dos dados exija uma estratégia de dados abrangente, é necessário um componente especializado para preencher a lacuna entre os dados brutos e o consumo do modelo. Complementando o mecanismo de computação, o Feast atua como a "memória" da solução. Executado no OpenShift, o Feast separa o modelo da infraestrutura de dados brutos para melhorar a conformidade e a reprodutibilidade.

O Feast gerencia a correção pontual, para o modelo ser treinado exatamente com os dados disponíveis em um momento histórico específico, evitando o vazamento de dados e permitindo a auditabilidade total.

- Armazenamento offline (por exemplo, MinIO): ele se conecta de forma segura ao armazenamento de objetos compatível com S3 isolado para lidar com dados históricos de alta taxa de transferência para treinamento.

- Loja online (por exemplo, Redis): ele gerencia funcionalidades de baixa latência para inferência, de modo que as decisões em tempo real sejam tomadas no perímetro de soberania.

- Registro de recursos: ele oferece uma "single source of truth" para definições de funcionalidades. Desse modo, as métricas críticas (por exemplo, "idade do paciente") são calculadas de forma idêntica por todos os cientistas de dados na plataforma, mantendo a integridade da inteligência soberana.

Conclusão do ciclo de vida: serviço de modelos soberanos

A verdadeira soberania vai além do treinamento e deve abranger todo o ciclo de vida do MLOps. Após um modelo ser treinado pelo Kubeflow, ele precisa ser implementado para processar dados em tempo real sem sair do perímetro de segurança.

O OpenShift AI fecha esse ciclo com recursos integrados de disponibilização de modelos. Com o uso de ferramentas como KServe, vLLM e suporte a llm-d para inferência distribuída na plataforma, as organizações podem implementar os artefatos do modelo imediatamente no mesmo cluster soberano isolado onde foram treinados. Isto significa:

- A inferência permanece interna: com o vLLM e o llm-d, as consultas do usuário (por exemplo, a solicitação de diagnóstico de um médico) e os fluxos de dados em tempo real são processados localmente, sem nunca passar por uma API pública. Essas tecnologias otimizam o uso da memória da GPU por meio do PagedAttention e permitem que modelos de base massivos sejam divididos em várias GPUs menores. Esse recurso otimizado torna a hospedagem de IA generativa de alto desempenho viável do ponto de vista financeiro e técnico, permitindo que as empresas utilizem sua própria infraestrutura em vez de depender das APIs de nuvens caras e não soberanas.

- Soberania unificada: da aceleração de hardware ao monitoramento de modelos, todo o fluxo (Gather [Feast] → Train [Kubeflow] → Serve [OpenShift AI]) é executado na infraestrutura soberana, sob seu controle.

Esse recurso conecta a fase de "desenvolvimento" diretamente às fases de "integração" e "monitoramento", o que significa que uma entidade regulamentada pode executar uma fábrica de IA completa e de nível internacional totalmente interna.

Arquitetura

O diagrama abaixo ilustra como o OpenShift AI atua como a camada de plataforma soberana, encapsulando a orquestração, a segurança e o gerenciamento de hardware necessários para executar o Kubeflow e o Feast em um ambiente isolado.

Conclusão

Para alcançar a IA soberana, é necessário mais do que apenas hardware local. É preciso uma arquitetura de software que respeite a importância dos dados e a complexidade dos fluxos de trabalho de IA modernos.

Ao usar tecnologias como o Kubeflow Training e o Feast no OpenShift AI, as organizações podem criar uma fábrica de IA soberana com as seguintes características:

- Reforçado por design: os dados fluem diretamente dentro do perímetro protegido, do armazenamento à computação, regidos pelo controle de acesso baseado em função (RBAC) de nível empresarial da Red Hat e pela conformidade opcional com os Padrões Federais de Processamento de Informações (FIPS).

- Escalável: como usar o poder do treinamento distribuído no Kubernetes com o gerenciamento automatizado de hardware oferecido pelo OpenShift AI e pelo Kubeflow Training.

- Reproduzível: uso de feature stores para oferecer suporte à linhagem de dados auditável.

Essa solução capacita países e empresas a aproveitar o poder da IA sem comprometer sua independência, transformando o desafio da soberania em uma vantagem competitiva.

Tudo pronto para criar sua própria fábrica de IA soberana?

- Conheça os aspectos técnicos: quer entender o código por trás da arquitetura? Há um tutorial técnico detalhado no blog Red Hat Developer: Aprimore a recuperação de RAG com o Feast e o Kubeflow Training.

- Descubra a plataforma: para uma visão geral mais detalhada, acesse o Red Hat OpenShift AI e explore como nossa plataforma de nível empresarial ajuda as organizações a criar, implementar e gerenciar aplicações de IA soberanas e protegidas em escala.

Recurso

A empresa adaptável: da prontidão para a IA à disrupção

Sobre o autor

Umberto Manganiello is a Staff Engineer at Red Hat since 2025. Prior to this, he spent over 15 years as a Principal Architect and Engineer in the Financial and Telecommunications sectors. He specializes in designing high-availability systems that operate at massive scale, leveraging deep expertise in Kubernetes, Kafka, and Cloud modernization. Currently, he applies this architectural discipline to the challenges of MLOps, with a focus on GenAI, OpenShift AI, and Kubeflow, blending cloud-native resilience with AI model training workflows.

Mais como este

Pare de gerenciar o passado e comece a construir o futuro da TI

OpenShift: integração consistente para a empresa híbrida

Technically Speaking | Build a production-ready AI toolbox

Technically Speaking | Platform engineering for AI agents

Navegue por canal

Automação

Últimas novidades em automação de TI para empresas de tecnologia, equipes e ambientes

Inteligência artificial

Descubra as atualizações nas plataformas que proporcionam aos clientes executar suas cargas de trabalho de IA em qualquer ambiente

Nuvem híbrida aberta

Veja como construímos um futuro mais flexível com a nuvem híbrida

Segurança

Veja as últimas novidades sobre como reduzimos riscos em ambientes e tecnologias

Edge computing

Saiba quais são as atualizações nas plataformas que simplificam as operações na borda

Infraestrutura

Saiba o que há de mais recente na plataforma Linux empresarial líder mundial

Aplicações

Conheça nossas soluções desenvolvidas para ajudar você a superar os desafios mais complexos de aplicações

Virtualização

O futuro da virtualização empresarial para suas cargas de trabalho on-premise ou na nuvem