-

Soluções e documentação Red Hat AI

Uma plataforma de soluções e serviços para desenvolvimento e implantação de IA na nuvem híbrida.

Red Hat AI Enterprise

Crie, desenvolva e implante aplicações com tecnologia de IA na nuvem híbrida.

Red Hat AI Inference Server

Otimize o desempenho do modelo com o vLLM e realize inferências de forma mais rápida, econômica e em escala.

Red Hat Enterprise Linux AI

Desenvolva, teste e execute modelos de IA generativa com recursos de inferência otimizados.

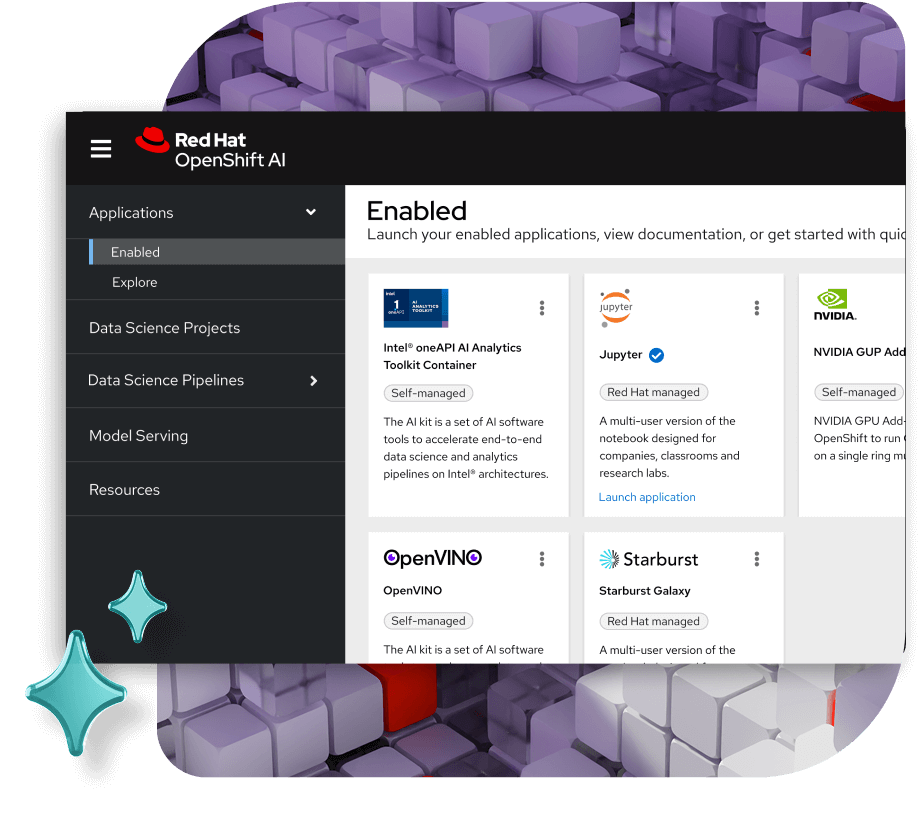

Red Hat OpenShift AI

Crie e implante modelos e aplicações com IA em escala em ambientes híbridos.

-

Aprenda Básico

-

Parceiros de IA

Modelos validados pelo Red Hat AI

Os modelos validados pelo Red Hat® AI oferecem confiança, previsibilidade e flexibilidade na implantação de modelos de IA generativa de terceiros nessa plataforma.

Qual o diferencial desses modelos validados?

Com tantas opções de Large Language Models (LLMs), configurações de servidor de inferência e aceleradores de hardware, fica difícil encontrar a combinação certa de desempenho, precisão e custo para seu caso de uso.

Com as atualizações mais recentes do Red Hat AI 3.3, nossa coleção de modelos validados facilita essa escolha. Nosso repositório de modelos de terceiros foi validado para execução eficiente na plataforma do Red Hat AI e agora inclui um novo lote de modelos de alto desempenho.

Novos modelos, como o IBM Granite 4 e o Apertus 8B, priorizam a transparência e a auditabilidade. Já o Mistral Large 3 é útil para quem exige soberania de dados na Europa. E a família de modelos Nemotron garante desempenho máximo para clientes que preferem a infraestrutura da NVIDIA.

Funcionalidades e benefícios

Maior flexibilidade

Acesse modelos validados e prontos para inferência no Hugging Face. Eles aceleram o time to value e garantem aplicações de IA mais consistentes e confiáveis.

Inferência otimizada

Otimize sua infraestrutura de IA com os modelos, configurações e aceleradores ideais para garantir uma implantação eficiente, econômica e sob medida para seu negócio.

Mais confiança

Use benchmarks e ferramentas de otimização para verificar, comprimir e validar modelos de terceiros em qualquer cenário de implantação

Faça mais com seus modelos

A validação de modelos do Red Hat AI é realizada com ferramentas open source como o GuideLLM, Language Model Evaluation Harness e vLLM para garantir a reprodutibilidade para os clientes.

Modelos validados

Não estamos falando de qualquer LLM. Testamos modelos de terceiros em cenários realistas para prever exatamente seu desempenho. Utilizamos ferramentas especializadas para avaliar o desempenho do LLM em uma variedade de hardwares.

- GuideLLM avalia o desempenho e o custo em diferentes configurações de hardware.

- LM Evaluation Harness testa a generalização dos modelos em diferentes tarefas.

Modelos otimizados

Passam por compressão para assegurar a alta velocidade e eficiência. Esses LLMs são projetados para ter execução mais rápida e usar menos recursos sem prejudicar a precisão, quando implantados no vLLM.

- LLM Compressor é uma biblioteca open source que reúne as pesquisas mais recentes em compressão de modelos em uma única ferramenta, permitindo gerar modelos compactos com mínimo esforço.

- vLLM é o principal mecanismo open source de inferência e disponibilização do setor. Ele oferece alto desempenho, aumenta a eficiência no uso de memória e otimiza os LLMs.

Desenvolva suas soluções com o Red Hat AI

O Red Hat AI é a plataforma de IA open source que funciona do seu jeito. Reduza custos com modelos eficientes, personalize-os com seus dados e expertise e implante e gerencie cargas de trabalho consistentemente em qualquer infraestrutura. Tudo isso com o uso de ferramentas que oferecem colaboração e escalabilidade para a sua equipe.

Perguntas frequentes

Onde encontro os modelos validados?

Os modelos validados estão disponíveis no Red Hat AI Ecosystem Catalog e no repositório do Red Hat AI no Hugging Face. Nesse repositório, você também encontra informações completas sobre os modelos, pesos do SafeTensor e comandos para acelerar as implantações no Red Hat AI Inference Server, RHEL AI e Red Hat OpenShift AI.

Com que frequência vocês disponibilizam novos modelos validados?

A intenção da Red Hat é disponibilizar um novo conjunto de modelos validados por mês, acompanhando a frequência dos lançamentos upstream do vLLM. A Red Hat se reserva o direito de interromper a validação de modelos por qualquer motivo.

Como é o ciclo de vida dos modelos validados?

A intenção é manter a validação dos modelos selecionados por pelo menos duas versões menores futuras do vLLM (n+2). Cada modelo validado em uma versão do vLLM será compatível com, no mínimo, as duas versões seguintes.

Os modelos validados e otimizados recebem suporte completo da equipe do Red Hat Support?

A Red Hat não oferece suporte, indenizações, certificações ou garantias para modelos de terceiros. Além disso, as orientações de capacidade são apenas recomendações, e não uma garantia de desempenho ou precisão. Para mais informações sobre licenças de modelos específicos, contate o fornecedor.

Como faço para receber orientações sobre implantação de LLMs, configurações e aceleradores de hardware com base no caso de uso da minha empresa?

Envie um e-mail a validated-models@redhat.com para receber mais informações.