Ofereça acesso compartilhado à IA com operações de modelos centralizadas

- Para engenheiros de IA, o MaaS oferece acesso mais rápido a modelos de alto desempenho por meio de APIs. Dessa forma, não é necessário fazer o download de modelos, gerenciar dependências ou solicitar alocações de GPU por meio de tickets de TI demorados.

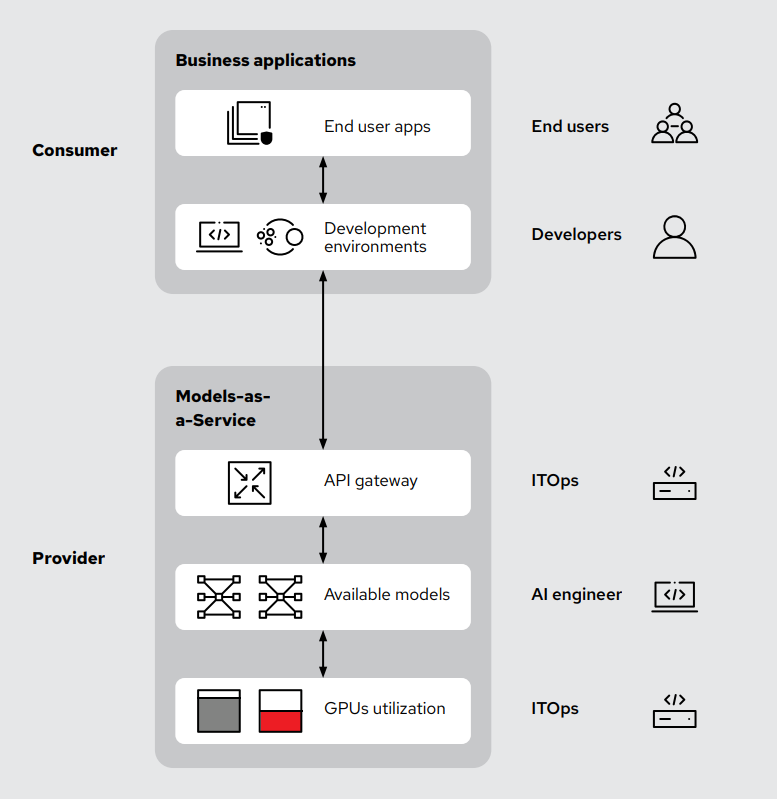

O MaaS funciona definindo uma equipe de operações como a proprietária central dos recursos de IA compartilhados. Os modelos são implantados em uma plataforma escalável (como o Red Hat® OpenShift® AI ou outras plataformas semelhantes) e expostos por meio de um gateway de API. Essa configuração permite que vários usuários, desenvolvedores e unidades de negócios ofereçam acesso simplificado para usuários finais e, ao mesmo tempo, atendam às prioridades de segurança e governança das equipes de TI e finanças. Essa priorização pode incluir recursos de chargeback, permitindo usar modelos sem precisar de acesso direto ao hardware nem necessidade de conhecimento técnico avançado. O objetivo é oferecer acesso intuitivo aos modelos de IA e não aos recursos necessários para executá-los, como GPUs e unidades de processamento de tensor (TPUs). Tudo isso atendendo aos requisitos de conformidade e desempenho empresarial, sem complicar o acesso para os usuários finais.

Na prática, os usuários interagem apenas com as APIs que oferecem respostas geradas por modelos. Assim como os provedores de IA pública simplificam as complexidades de hardware para os usuários finais, as implantações internas de MaaS oferecem o mesmo nível de simplicidade. Os usuários não gerenciam a infraestrutura de hardware ou software, nem precisam esperar por um ticket de TI ou pela configuração de um ambiente. Em vez disso, as equipes de operações de TI e IA gerenciam centralmente o ciclo de vida do modelo, a segurança, as atualizações e a escala da infraestrutura, oferecendo aos usuários acesso simplificado e controlado.

Essa centralização simplifica as operações internas de IA e aprimora o foco e a governança de segurança. O acesso aos modelos de IA é rigorosamente controlado por meio do gerenciamento de credenciais via um gateway de API. As organizações podem rastrear o uso, configurar mecanismos internos de chargeback, garantir que as diretrizes de conformidade de privacidade estejam sendo seguidas e estabelecer limites operacionais claros, o que faz da IA empresarial gerenciável e viável. O rastreamento no nível de tokens (entrada e saída) é mais preciso e granular do que qualquer métrica baseada na GPU.

Controle o uso, limite o acesso e gerencie os custos

- Os engenheiros de TI e de plataforma se beneficiam da supervisão centralizada. Isso impede implantações de modelos não autorizados, reforça os padrões de segurança e conformidade e simplifica o gerenciamento da infraestrutura e do ciclo de vida.

- Para as equipes financeiras, o rastreamento de uso centralizado e os mecanismos internos de chargeback reduzem o desperdício e tornam o uso da GPU mais previsível e responsável. Dessa forma, evitam desperdícios com hardware dedicado a equipes e pouco utilizado.

Em um MaaS, o controle vem da integração entre o gateway de API e a infraestrutura de IA, permitindo às equipes gerenciar e monitorar o uso com alta granularidade.

As implantações tradicionais de IA tendem a ter uso ineficiente e sem gerenciamento, pois pessoas ou equipes implantam modelos de forma independente, sem supervisão centralizada. Essa abordagem fragmentada pode gerar ineficiências dispendiosas, com recursos de GPU ociosos ou subutilizados. Com um gateway de API no centro da infraestrutura de IA, é possível criar um ponto de acesso controlado entre usuários e modelos.

Esse arranjo facilita o rastreamento preciso do uso até o nível do token individual. As equipes podem identificar claramente o quanto cada usuário, equipe ou aplicação consome, atribuindo com precisão os custos de GPU e infraestrutura. Por exemplo, as organizações podem determinar se um usuário ou aplicação está usando recursos excessivamente e tomar medidas corretivas, como limitar o uso ou alocar custos por meio de mecanismos internos de chargeback.

Os mecanismos de limitação do gateway de API asseguram um desempenho consistente e evitam o esgotamento de recursos. Com a limitação de uso, as equipes de TI gerenciam a intensidade do acesso, evitando que só um usuário monopolize os recursos da GPU ou prejudique a experiência dos outros.

Além disso, os gateways de API oferecem controle de acesso e gerenciamento de credenciais de alta granularidade. Os usuários internos podem gerar credenciais para acessar modelos de IA de forma independente, aliviando a sobrecarga administrativa. As credenciais também podem ser revogadas ou modificadas em menos tempo para responder às mudanças nos requisitos de segurança ou nos padrões de uso.

Tudo isso significa que o gerenciamento de custos se torna mais transparente e responsável. As equipes de TI podem alocar com precisão os gastos com GPU e infraestrutura entre as equipes ou unidades de negócios que os consomem.

Trabalhe com qualquer modelo, acelerador e nuvem

Um princípio fundamental da abordagem MaaS é o controle. Ele permite que as organizações selecionem e implantem uma ampla variedade de modelos de IA, escolham seus aceleradores de hardware de preferência e operem em seus ambientes existentes de nuvem ou on-premise. Com essa abordagem, as organizações têm a liberdade de implementar a IA conforme suas necessidades técnicas, requisitos de segurança e preferências operacionais.

- As organizações enfrentam limitações rígidas ao adotar a IA, que costumam ser:

- Restritas por serviços em nuvem específicos.

- Dependentes de ecossistemas de modelos proprietários.

- Limitadas por infraestruturas de hardware fixas.

- O MaaS resolve essas limitações de várias maneiras, incluindo:

- Compatibilidade com modelos open source ou proprietários, modelos treinados personalizados e LLMs mais conhecidos, como Llama e Mistral.

- Extensão além dos modelos baseados em texto para incluir análise preditiva, visão computacional, ferramentas de transcrição de áudio e outros casos de uso de gen AI multimodal, como geração de imagem ou vídeo.

- O MaaS permanece independente dos aceleradores de hardware. Dessa forma:

- As organizações podem selecionar GPUs ou outros aceleradores que se alinhem às suas cargas de trabalho, estruturas de custo e necessidades de desempenho.

- Equipes de IA centralizadas podem tomar decisões críticas de dimensionamento e implantação, melhorando a eficiência e reduzindo os erros de usuários menos técnicos.

- O gerenciamento centralizado permite:

- Alocação e uso ideais da infraestrutura.

- Redução das despesas operacionais e prevenção de erros de configuração de recursos.

- O MaaS é compatível com implantações em qualquer ambiente, incluindo:

- Ambientes isolados, on-premise, nuvens híbrida e pública, sendo muito relevantes para setores altamente regulamentados que exigem soberania de dados, conformidade regulatória ou controles de segurança rigorosos.