-

Produits et documentation Red Hat AI

Plateforme de produits et de services pour le développement et le déploiement de l'IA dans le cloud hybride.

Red Hat AI Enterprise

Créez, développez et déployez des applications basées sur l'IA dans le cloud hybride.

Red Hat AI Inference Server

Optimisation des performances des modèles avec le vLLM pour des inférences rapides et rentables à grande échelle.

Red Hat Enterprise Linux AI

Développez, testez et exécutez des modèles d'IA générative avec des capacités d'inférence optimisées.

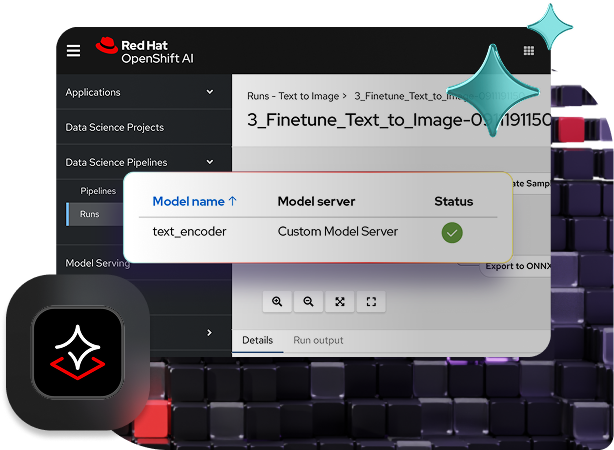

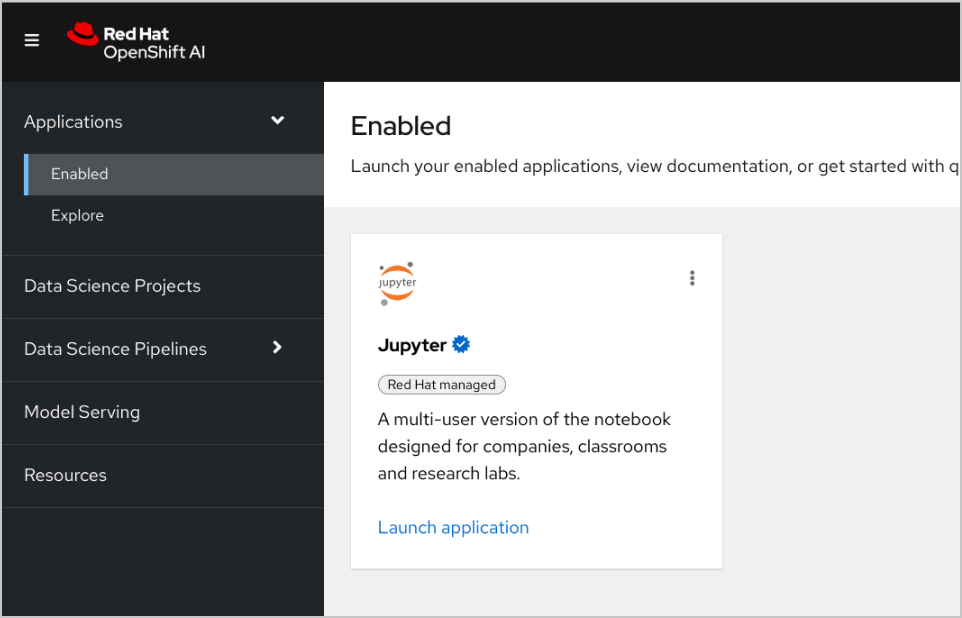

Red Hat OpenShift AI

Assemblage et déploiement de modèles et d'applications basés sur l'IA à grande échelle dans des environnements hybrides.

-

Se former Notions de base

- Nouveautés de Red Hat AI

- Comprendre l'importance de l'inférence d'IA

- Le framework vLLM, qu'est-ce que c'est ?

- Les inférences d'IA, qu'est-ce que c'est ?

- IA prédictive et IA générative

- L'IA agentique, qu'est-ce que c'est ?

- RAG et réglage fin

- Voir tous les thèmes liés à l'IA

- Voir tous les articles de blog sur l'IA

Ressources techniques

-

Partenaires pour l'IA

Red Hat OpenShift AI

Red Hat OpenShift AI est une plateforme d'IA qui permet de gérer le cycle de vie des modèles prédictifs et génératifs à grande échelle dans les environnements de cloud hybride.

Présentation de Red Hat OpenShift AI

Conçue autour de technologies Open Source, cette solution offre aux équipes des fonctionnalités fiables et cohérentes pour faire des expériences, déployer des modèles et distribuer des applications innovantes.

En plus de l'accélération du matériel, la solution OpenShift AI permet l'acquisition et la préparation des données ainsi que l'entraînement, la surveillance, le réglage fin et la mise à disposition des modèles. En association avec les solutions de l'écosystème Open Source de partenaires fournisseurs de matériel et de logiciels, OpenShift AI offre la flexibilité nécessaire pour traiter les cas d'utilisation spécifiques.

Accélérez la mise en production de vos applications basées sur l'IA

Réunissez vos équipes autour d'une seule et même plateforme d'applications d'IA pour les entreprises qui associe les capacités éprouvées de Red Hat OpenShift AI et de Red Hat OpenShift. Les équipes de science des données, d'ingénierie et de développement d'applications peuvent collaborer au sein d'un espace unique qui favorise la cohérence, la sécurité et l'évolutivité.

La dernière version d'OpenShift AI comprend une sélection de modèles tiers optimisés et prêts pour une mise en production, validés pour Red Hat OpenShift AI. En accédant à ce catalogue, les équipes bénéficient d'un meilleur contrôle sur l'accès et la visibilité des modèles, ce qui les aide à répondre aux exigences de sécurité et à celles fixées par les politiques.

De plus, avec sa structure optimisée basée sur vLLM, OpenShift AI permet de réduire les coûts liés à l'inférence en ayant recours à une mise à disposition distribuée. Pour simplifier l'exploitation, cette solution inclut des outils avancés qui permettent d'automatiser les déploiements, ainsi qu'un accès en libre-service à des modèles, outils et ressources.

Fonctions et avantages

Réduction du temps consacré à la gestion de l'infrastructure d'IA

Les clients bénéficient d'un accès sur demande à des modèles hautes performances pour simplifier le libre-service, la mise à l'échelle et la distribution. Ainsi, les équipes de développement évitent la complexité, gardent le contrôle et optimisent les coûts.

Certains aspects, comme le MaaS (Models-as-a-Service), sont encore en version préliminaire pour les développeurs. Ce système offre une approche d'accès à l'IA axée sur des points de terminaison d'API pour accélérer l'IA et respecter la confidentialité, et ce à grande échelle.

Outils d'IA/AA testés et pris en charge

Red Hat teste, intègre et prend en charge les outils d'IA/AA ainsi que la mise à disposition des modèles pour ses clients. La solution OpenShift AI s'appuie sur notre projet communautaire Open Data Hub, ainsi que sur d'autres projets Open Source, notamment Kubeflow.

Notre expérience et notre expertise en matière d'Open Source nous permet de fournir une basée adaptée à l'IA générative, ce qui donne un plus large éventail de choix à nos clients et leur inspire confiance pour leurs stratégies axées sur cette technologie.

Flexibilité dans le cloud hybride

Red Hat OpenShift AI offre une plateforme sûre et flexible qui permet de développer et déployer des modèles dans tout type d'environnement : sur site, dans le cloud public ou à la périphérie du réseau.

Mise en œuvre de nos meilleures pratiques

Les Services Red Hat partagent leur expertise, et proposent des formations et une assistance pour surmonter les défis de l'IA à tout moment dans le parcours d'adoption.

Que ce soit pour créer un prototype de solution d'IA, rationaliser le déploiement d'une plateforme d'IA ou faire avancer des stratégies MLOps, les services de consulting Red Hat proposent une assistance.

Guides de démarrage rapide pour l'IA

Découvrez divers cas d'utilisation innovants de l'IA, développés par notre communauté. Ces exemples simples et ciblés ont été conçus pour accélérer et simplifier le déploiement d'applications sur la plateforme Red Hat AI.

Des schémas bien définis pour les équipes de développement avec llm-d

L'offre Red Hat OpenShift AI comprend llm-d, un framework Open Source qui relève les défis de l'inférence d'IA distribuée à grande échelle.

La mise à l'échelle des modèles sur un ensemble de GPU non centralisé renforce le contrôle et l'observabilité. En séparant le pipeline d'inférence en différents services intelligents et modulaires, les entreprises optimisent les LLM complexes à grande échelle.

Serveurs MCP pour Red Hat OpenShift AI

Découvrez notre sélection de serveurs MCP mis à disposition par des partenaires technologiques, compatibles avec une intégration Red Hat OpenShift AI.

Le protocole MCP (Model Context Protocol) est un protocole Open Source qui permet une connexion bidirectionnelle et une communication standardisée entre des applications d'IA et des services externes.

Il est désormais possible de tirer parti de ces serveurs MCP pour intégrer des outils et ressources d'entreprise aux applications d'IA et aux workflows agentiques.

Optimisation avec le vLLM pour des inférences rapides et rentables à grande échelle.

Red Hat AI Inference Server fait partie de la plateforme Red Hat AI. Il est disponible en tant que produit autonome et inclus dans Red Hat Enterprise Linux® AI et Red Hat OpenShift® AI.

L'IA à votre service, selon vos conditions

IA générative

Produisez des contenus, comme du texte et du code logiciel.

La gamme Red Hat AI vous permet d'exécuter plus rapidement les modèles d'IA générative de votre choix, en utilisant moins de ressources et en réduisant les coûts d'inférence.

IA prédictive

Mettez en relation des schémas et prévoyez des résultats futurs.

Grâce à la gamme Red Hat AI, les entreprises peuvent développer, entraîner, surveiller et mettre à disposition des modèles prédictifs, tout en assurant la cohérence dans le cloud hybride.

Mise en œuvre de l'IA

Créez des systèmes qui prennent en charge la maintenance et le déploiement de l'IA à grande échelle.

Grâce à la gamme Red Hat AI, gérez et surveillez le cycle de vie des applications basées sur l'IA, tout en économisant des ressources et en garantissant la conformité avec les réglementations en matière de confidentialité.

IA agentique

Créez des workflows capables de réaliser des tâches complexes avec une supervision limitée.

La gamme Red Hat AI propose une approche flexible et une base solide pour concevoir, gérer et déployer des workflows d'IA agentique dans vos applications existantes.

Partenariats

Tirez le meilleur parti de la plateforme Red Hat OpenShift AI en l'associant à d'autres produits et services.

NVIDIA et Red Hat offrent aux clients une plateforme évolutive qui accélère divers cas d'utilisation de l'IA avec une flexibilité inégalée.

Intel® et Red Hat aident les entreprises à accélérer l'adoption de l'IA et l'exploitation des modèles d'IA/AA.

IBM et Red Hat proposent des innovations Open Source pour accélérer le développement de l'IA, notamment grâce à IBM watsonx.aiTM, un studio d'IA prêt à l'emploi pour la création de systèmes d'IA.

Starburst Enterprise et Red Hat contribuent à améliorer la précision et la pertinence des informations grâce à une analyse rapide des données sur plusieurs plateformes de données disparates et distribuées.

Collaboration sur des workbenches de modèles

Le hub d'IA et le studio d'IA générative donnent aux équipes d'ingénierie de plateforme et d'IA la possibilité de collaborer dans le but de mettre en production des modèles plus rapidement.

Le hub d'IA permet de gérer les LLM avec des charges de travail centralisées tout en recevant des informations relatives aux performances de la part d'une validation de modèle tierce. Le studio d'IA générative fournit un environnement pratique où interagir avec les modèles et créer rapidement des applications basées sur cette technologie pour expérimenter. Il est possible de vérifier l'adéquation du modèle avant l'intégration au cycle de vie grâce au sandbox, qui permet de tester les flux de discussion et de génération augmentée de récupération (RAG).

De plus, les data scientists peuvent accéder à des images de cluster préconçues ou personnalisées pour travailler sur des modèles avec leurs frameworks et environnements de développement intégrés favoris. La solution Red Hat OpenShift AI suit les changements apportés à de nombreuses technologies Open Source d'IA, notamment Jupyter, PyTorch et Kubeflow.

Red Hat OpenShift AI pour un déploiement évolutif et sûr des modèles

Les modèles peuvent être distribués à l'aide d'une version optimisée de vLLM (ou d'autres serveurs de modèles) en vue d'une intégration à des applications basées sur l'IA sur site, dans le cloud public ou à la périphérie du réseau. Il est possible de les récréer, de les redéployer et de les surveiller en fonction des modifications apportées au notebook source.

Les hallucinations et les biais compromettent l'intégrité des modèles et rendent la mise à l'échelle plus difficile. Pour assurer l'équité, la sécurité et l'évolutivité, OpenShift AI donne aux spécialistes des données des outils pour vérifier l'alignement entre les résultats des modèles et leurs données d'entraînement.

Les systèmes de détection des dérives identifient les occurrences où les données utilisées lors des opérations d'inférence présentent un écart par rapport aux données d'entraînement d'origine. Les mécanismes de contrôle de l'IA intégrés protègent les entrées et sorties des modèles contre les informations nuisibles, comme les propos abusifs et grossiers, les données à caractère personnel ou d'autres risques propres à un domaine.

Témoignages client du Red Hat Summit et d'AnsibleFest 2025 en lien avec l'IA

Avec un accès aux données à l'échelle de l'entreprise, Turkish Airlines a pu déployer des systèmes deux fois plus vite.

La JCCM a amélioré les processus d'évaluation environnementale de la région grâce à l'IA.

DenizBank a fait passer le délai de mise sur le marché de plusieurs jours à quelques minutes seulement.

Hitachi a mis en œuvre l'IA dans toutes ses activités avec Red Hat OpenShift AI.

Essayez Red Hat OpenShift AI

Sandbox de développement

Pour les équipes de développement et de science des données qui souhaitent expérimenter la création d'applications basées sur l'IA dans un environnement préconfiguré et flexible.

Essai de 60 jours

Pour les équipes qui sont prêtes à évaluer toutes les capacités d'OpenShift AI. Un cluster Red Hat OpenShift existant est nécessaire.