-

Produits et documentation Red Hat AI

Plateforme de produits et de services pour le développement et le déploiement de l'IA dans le cloud hybride.

Red Hat AI Enterprise

Créez, développez et déployez des applications basées sur l'IA dans le cloud hybride.

Red Hat AI Inference Server

Optimisation des performances des modèles avec le vLLM pour des inférences rapides et rentables à grande échelle.

Red Hat Enterprise Linux AI

Développez, testez et exécutez des modèles d'IA générative avec des capacités d'inférence optimisées.

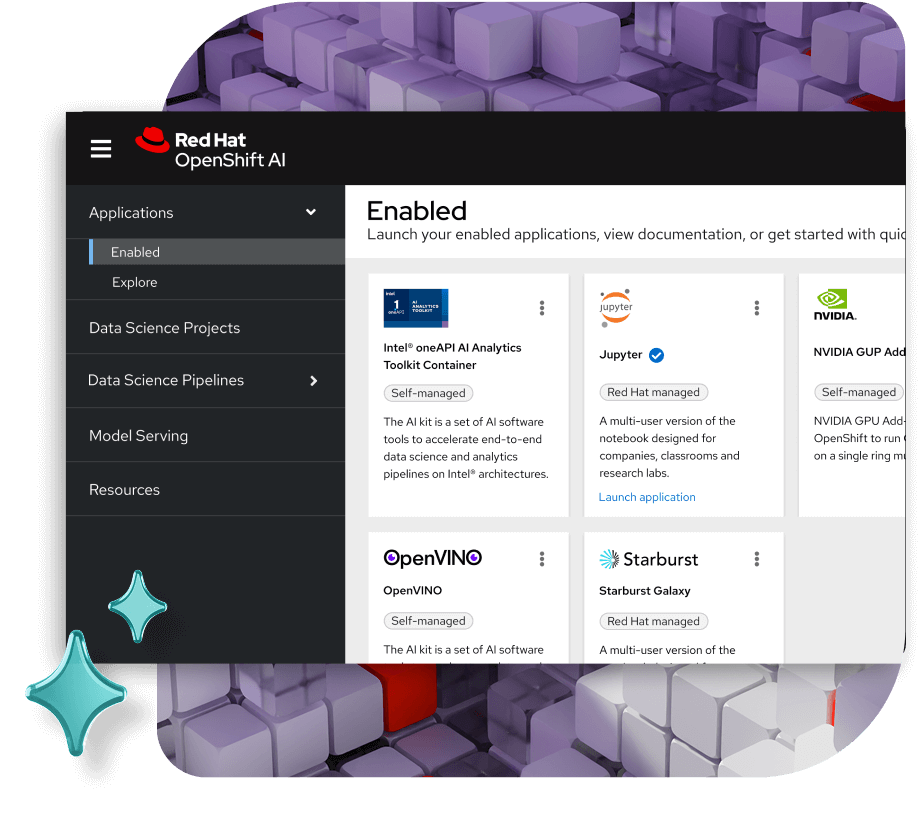

Red Hat OpenShift AI

Assemblage et déploiement de modèles et d'applications basés sur l'IA à grande échelle dans des environnements hybrides.

-

Se former Notions de base

- Nouveautés de Red Hat AI

- Comprendre l'importance de l'inférence d'IA

- Le framework vLLM, qu'est-ce que c'est ?

- Les inférences d'IA, qu'est-ce que c'est ?

- IA prédictive et IA générative

- L'IA agentique, qu'est-ce que c'est ?

- RAG et réglage fin

- Voir tous les thèmes liés à l'IA

- Voir tous les articles de blog sur l'IA

Ressources techniques

-

Partenaires pour l'IA

Modèles validés par Red Hat AI

Les modèles validés par Red Hat® AI offrent fiabilité, prévisibilité et flexibilité dans le cadre du déploiement de modèles d'IA générative tiers avec Red Hat AI.

Les particularités des modèles validés

Face à la multitude de grands modèles de langage (LLM), de paramètres de serveur d'inférence et d'accélérateurs matériels, il est difficile de trouver la combinaison qui offrira la meilleur niveau de performances, de précision et de coût pour chaque cas d'utilisation.

Avec les dernières mises à jour apportées à Red Hat AI 3.3, ce choix devient plus simple grâce à notre collection de modèles validés. Les modèles tiers disponibles dans notre référentiel sont validés pour une exécution efficace sur la plateforme Red Hat AI. De nouveaux modèles hautement performants viennent d'être ajoutés.

Les nouveaux modèles comme IBM Granite 4 et Apertus 8B mettent l'accent sur la transparence et l'auditabilité. Le modèle Mistral Large 3 s'adresse aux entreprises qui doivent privilégier la souveraineté des données en Europe. Enfin, la famille de modèles Nemotron de NVIDIA garantit des performances élevées aux clients qui préfèrent une infrastructure NVIDIA.

Fonctions et avantages

Flexibilité accrue

Hébergés sur Hugging Face, les modèles validés, optimisés et prêts pour l'inférence vous aident à réduire le délai de rentabilisation, ainsi qu'à renforcer la cohérence et la fiabilité de vos applications d'IA.

Inférence optimisée

Optimisez votre infrastructure d'IA en choisissant le modèle, les paramètres de déploiement et les accélérateurs matériels appropriés afin d'obtenir des déploiements efficaces, rentables et adaptés aux cas d'utilisation de votre entreprise.

Confiance améliorée

Accédez à des tests de performances, à des évaluations de la précision et à des outils d'optimisation des modèles pour évaluer, compresser et valider des modèles tiers dans différents scénarios de déploiement.

Exploitez tout le potentiel de vos modèles

La validation des modèles est réalisée à l'aide d'outils Open Source tels que les frameworks GuideLLM, Language Model Evaluation Harness et vLLM pour garantir la reproductibilité.

Modèles validés

Ces modèles ne sont pas des LLM standards. Les modèles tiers sont testés dans le cadre de scénarios concrets afin de déterminer leurs performances en conditions réelles. Nous utilisons des outils spécialisés pour évaluer les performances des LLM dans diverses configurations matérielles.

- L'outil GuideLLM évalue les performances et les coûts dans plusieurs configurations matérielles.

- L'outil LM Evaluation Harness teste la généralisation des modèles pour plusieurs tâches.

Modèles optimisés

Ces modèles sont compressés pour offrir rapidité et efficacité. Ces LLM sont conçus pour s'exécuter plus vite et utiliser moins de ressources, sans dégrader la précision dans le cadre de leur déploiement sur vLLM.

- L'outil LLM Compressor est une bibliothèque Open Source qui inclut les derniers résultats de la recherche en matière de compression de modèles et qui permet de générer facilement des modèles compressés.

- vLLM est le principal moteur Open Source d'inférence et de distribution offrant un débit élevé et une utilisation efficace de la mémoire pour les LLM optimisés.

Assemblez des solutions adaptées avec Red Hat AI

Les solutions d'IA Open Source Red Hat AI s'adaptent à vos besoins. Réduisez les coûts grâce à des modèles efficaces, personnalisez-les avec vos données et vos connaissances du domaine, et assurez la cohérence du déploiement et de la gestion des charges de travail dans toutes les infrastructures. Nos outils aident vos équipes à collaborer et à évoluer.

Foire aux questions

Où trouver les modèles validés ?

Les modèles validés sont disponibles dans les référentiels Red Hat AI Ecosystem Catalog et Red Hat AI sur Hugging Face. Ce dernier inclut la description complète des modèles, les pondérations SafeTensor et les commandes pour un déploiement rapide sur Red Hat AI Inference Server, RHEL AI et Red Hat OpenShift AI.

À quelle fréquence de nouveaux modèles validés sont-ils ajoutés ?

Nous prévoyons d'ajouter un nouvel ensemble de modèles validés tous les mois, pour suivre le rythme de lancement des versions du projet vLLM en amont. Red Hat se réserve le droit d'interrompre la validation de modèles quelle qu'en soit la raison.

Quel est le cycle de vie d'un modèle validé ?

Les modèles sélectionnés sont validés à partir des versions N+2 mineures du vLLM au minimum, de manière transparente. Pour chaque modèle validé sur une version du vLLM, nous nous efforçons de garantir la compatibilité avec les deux prochaines versions du vLLM au minimum.

Ces modèles optimisés et validés sont-ils entièrement pris en charge par l'équipe d'assistance Red Hat ?

Non. Les modèles tiers ne sont pas pris en charge, indemnisés, certifiés ou garantis de quelque manière que ce soit par Red Hat. De plus, notez que les recommandations concernant les capacités sont données à titre informatif uniquement et ne garantissent pas les performances ou la précision. Pour en savoir plus sur la licence d'un modèle donné, contactez son fournisseur.

Comment obtenir des recommandations sur le déploiement, la configuration et les accélérateurs matériels pour un cas d'utilisation spécifique ?

Pour en savoir plus, envoyez vos questions à l'adresse validated-models@redhat.com.