-

Prodotti e documentazione Red Hat AI

Una piattaforma di prodotti e servizi per lo sviluppo e il deployment dell'IA nel cloud ibrido.

Red Hat AI Enterprise

Crea, sviluppa e distribuisci applicazioni basate sull'IA nel cloud ibrido.

Red Hat AI Inference Server

Ottimizza le prestazioni dei modelli con vLLM per un'inferenza rapida e conveniente in modo scalabile.

Red Hat Enterprise Linux AI

Sviluppa, testa ed esegui modelli di IA generativa con funzionalità di inferenza ottimizzate.

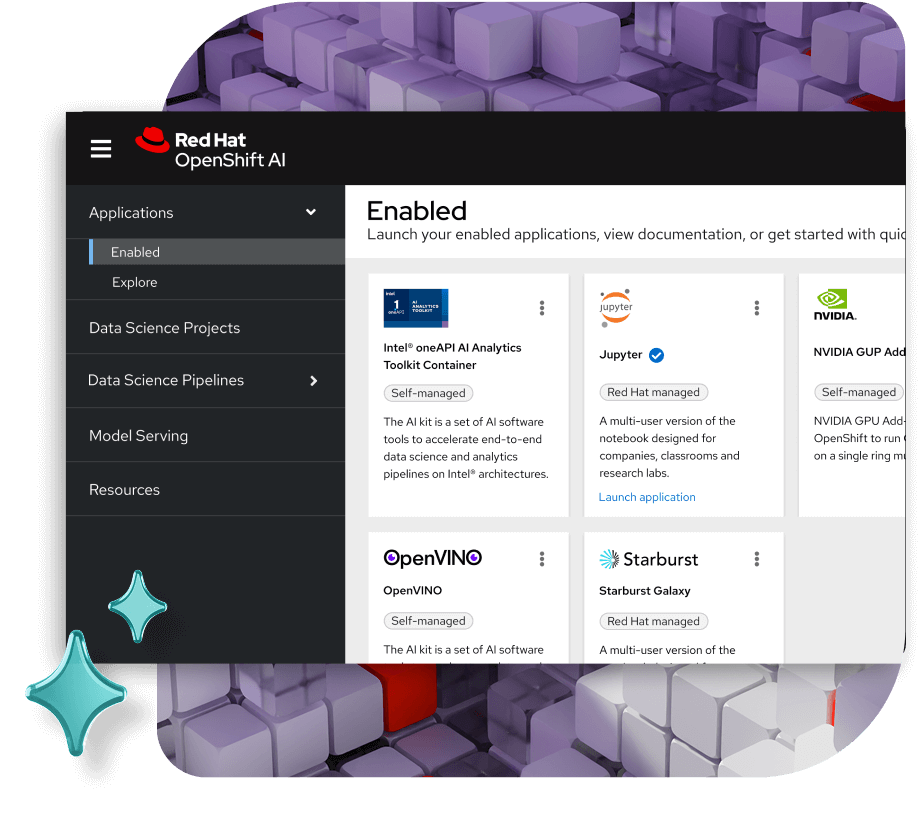

Red Hat OpenShift AI

Crea e distribuisci applicazioni e modelli basati sull'IA in modo scalabile negli ambienti ibridi.

-

Formazione Concetti di base

-

Partner per l'IA

I modelli convalidati da Red Hat AI

Grazie ai modelli convalidati da Red Hat® AI gli utenti possono distribuire i modelli di IA gen sviluppati da terze parti su Red Hat AI in maniera sicura, prevedibile e flessibile.

Cosa rende così speciali questi modelli convalidati?

Con così tanti modelli linguistici di grandi dimensioni (LLM), impostazioni per i server di inferenza e opzioni di accelerazione hardware, è difficile trovare l'equilibrio giusto tra prestazioni, accuratezza e costi per il tuo scenario di utilizzo.

Grazie agli ultimi aggiornamenti di Red Hat AI 3.3, la nostra raccolta di modelli convalidati semplifica la scelta. Il nostro repository di modelli di terze parti è stato convalidato per funzionare in modo efficiente sulla piattaforma Red Hat AI e ora include un nuovo batch di modelli ad alte prestazioni.

I nuovi modelli, come IBM Granite 4 e Apertus 8B, danno priorità a trasparenza e verificabilità. Mistral Large 3 supporta chi ha bisogno di sovranità dei dati in Europa. Inoltre, la famiglia di modelli Nemotron di NVIDIA garantisce le massime prestazioni ai clienti che preferiscono l'infrastruttura NVIDIA.

Caratteristiche e vantaggi

Flessibilità aumentata

Accedi alla raccolta di modelli convalidati e ottimizzati per l'inferenza in hosting su Hugging Face. I modelli convalidati aiutano ad aumentare la coerenza e l'affidabilità delle app di IA, accorciando il time to value.

Inferenza ottimizzata

Razionalizza l'infrastruttura di IA e riduci i costi e i tempi di deployment scegliendo il modello, le impostazioni di deployment e gli acceleratori hardware più adatti agli scenari di utilizzo aziendali.

Maggiore sicurezza

Accedi a benchmark di settore, valutazioni dell'accuratezza e strumenti di ottimizzazione dei modelli per analizzare, comprimere e convalidare i modelli di terze parti per il deployment in diversi scenari.

Massimizza i vantaggi dei tuoi modelli

La convalida del modello di Red Hat AI si esegue tramite strumenti open source, quali GuideLLM, Language Model Evaluation Harness e vLLM , per assicurare la riproducibilità.

Modelli convalidati

Questi non sono LLM qualunque. Testiamo i modelli di terze parti in scenari realistici per esaminare come si comporteranno in contesti reali. Utilizziamo strumenti specifici per valutare le prestazioni degli LLM su diversi hardware.

- GuideLLM valuta le prestazioni e i costi dell'esecuzione su diverse configurazioni hardware.

- LM Evaluation Harness testa la capacità di generalizzazione dei modelli in diversi contesti.

Modelli ottimizzati

Sottoposti a compressione per aumentare velocità ed efficienza. Questi LLM sono progettati per il deployment su vLLM dove garantiscono prestazioni e accuratezza elevate e una significativa riduzione nell'utilizzo di risorse.

- LLM Compressor è una libreria open source che accorpa in un unico strumento le ultime tecnologie per la compressione dei modelli in maniera più efficiente e rapida.

- vLLM è il principale motore inferenziale e di model serving open source che assicura elevata produttività e basso consumo di memoria per LLM ottimizzati.

Sviluppa le soluzioni di cui hai bisogno con Red Hat AI

Red Hat AI è la piattaforma IA open source che funziona come vuoi tu. Riduci i costi con modelli efficienti, personalizzali con i tuoi dati e con la tua esperienza del settore e distribuisci e gestisci i carichi di lavoro in modo coerente su qualsiasi infrastruttura. Il tutto con strumenti ideati per aiutare i tuoi team a collaborare e a essere scalabili.

Domande frequenti

Dove posso trovare i modelli convalidati?

I modelli convalidati sono disponibili nel Red Hat AI Ecosystem Catalog e nel repository di Red Hat AI su Hugging Face. Su Hugging Face sono presenti anche informazioni complete sui modelli, pesi SafeTensor e comandi per snellire il deployment su Red Hat AI Inference Server, RHEL AI e Red Hat OpenShift AI.

Con che frequenza vengono aggiunti nuovi modelli convalidati?

Red Hat punta a rilasciare un nuovo set di modelli convalidati al mese in base all'uscita delle nuove versioni di vLLM upstream. Red Hat si riserva il diritto di sospendere la convalida dei modelli per qualsivoglia motivo.

Qual è il ciclo di vita dei modelli convalidati?

I modelli selezionati vengono convalidati per un minimo di n+2 versioni secondarie di vLLM. Questo significa che ciascun modello viene convalidato su una determinata versione di vLLM e Red Hat si impegna a garantire la compatibilità del modello per almeno due versioni successive di vLLM.

I modelli ottimizzati e convalidati godono del supporto completo di Red Hat Support?

No, Red Hat non si occupa di supportare, tutelare, certificare o garantire in alcun modo i modelli di terze parti. Inoltre, le valutazioni sulla capacità sono semplici indicazioni e non una garanzia di prestazioni o accuratezza. Per maggiori dettagli sulla licenza di un modello specifico, contatta il provider del modello.

È possibile ricevere assistenza personalizzata per quanto riguarda configurazione, deployment del modello LLM e uso di acceleratori hardware per il proprio scenario di utilizzo?

Per maggiori informazioni, invia una richiesta a validated-models@redhat.com.