-

Soluções e documentação Red Hat AI

Uma plataforma de soluções e serviços para desenvolvimento e implantação de IA na nuvem híbrida.

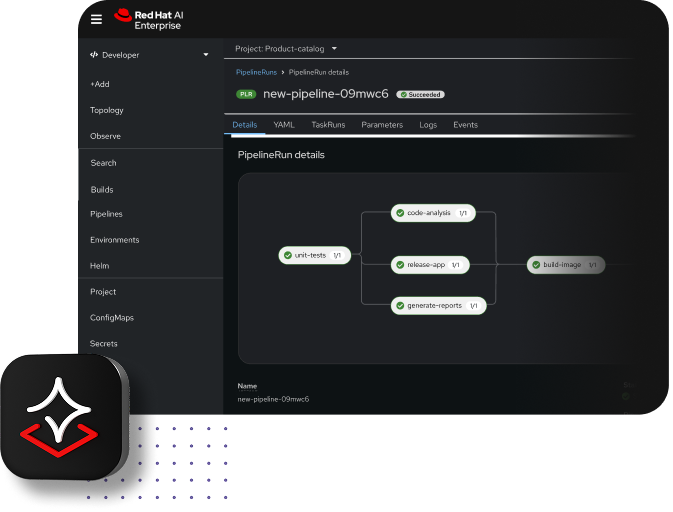

Red Hat AI Enterprise

Crie, desenvolva e implante aplicações com tecnologia de IA na nuvem híbrida.

Red Hat AI Inference Server

Otimize o desempenho do modelo com o vLLM e realize inferências de forma mais rápida, econômica e em escala.

Red Hat Enterprise Linux AI

Desenvolva, teste e execute modelos de IA generativa com recursos de inferência otimizados.

Red Hat OpenShift AI

Crie e implante modelos e aplicações com IA em escala em ambientes híbridos.

-

Aprenda Básico

-

Parceiros de IA

Red Hat AI

Acelere o desenvolvimento e a implantação de soluções de IA empresarial com uma base confiável e compatível com todos os modelos e agentes, executados em qualquer acelerador de hardware, na nuvem híbrida.

O Red Hat AI ampliou a flexibilidade e a eficiência agêntica com seu lançamento mais recente:

o Red Hat AI 3.4 chegou.

Entregue agentic AI em uma plataforma pronta para isso

A agentic AI evolui a experiência de IA da conversação para a execução autônoma.

Com o Red Hat® AI, você pode trazer seus próprios agentes e implantá-los com a governança e o controle que as empresas exigem.

233% de ROI com o Red Hat AI

Um estudo da Forrester Consulting, patrocinado pela Red Hat, descobriu que uma organização multifacetada (com base nos clientes atuais do Red Hat AI) obteve um ROI de 233% com a implantação do Red Hat AI.1

Por que escolher o Red Hat AI?

Desenvolva em uma base confiável, compatível com todos os modelos e agentes em qualquer acelerador de hardware na nuvem híbrida. O Red Hat AI oferece às organizações a liberdade de implantar onde seus requisitos de custo, dados e conformidade exigirem.

Inferência

Gerencie a complexidade dos modelos com a inferência rápida e eficiente baseada na tecnologia de vLLM e o controle de executar qualquer modelo em qualquer acelerador na nuvem híbrida.

Dados

Personalize casos de uso de agentic AI contextualizados com modelos conectados aos dados privados da sua organização.

Agentes

Acelere e simplifique sua jornada de adoção da agentic AI com governança e controle.

Plataforma

Implante soluções de IA resilientes e confiáveis em uma base de transparência open source e escalabilidade da nuvem híbrida.

O que o Red Hat AI oferece?

Para assegurar a flexibilidade e consistência necessárias para escalar a IA na nuvem híbrida, o Red Hat AI conta com um portfólio de soluções completo.

Para criar, desenvolver e implantar a IA na nuvem híbrida

O Red Hat AI Enterprise é um ambiente de desenvolvimento pronto para uso com recursos de nível empresarial. Ele unifica os ciclos de vida de aplicações e modelos de IA para melhorar a eficiência, acelerar a entrega e mitigar riscos.

Para inferência consistente, rápida e econômica em grande escala

Baseado em tecnologias open source como vLLM e llm-d, o Red Hat AI Inference oferece a flexibilidade para escalar na nuvem híbrida com o modelo e acelerador de sua preferência.

Para treinamento, ajuste, implantação e monitoramento de modelos de machine learning

Baseado nos recursos do Red Hat OpenShift®, o Red Hat OpenShift AI é uma plataforma para gerenciar o ciclo de vida de modelos de IA preditiva e IA generativa (gen AI) em grande escala nos ambientes de nuvem híbrida.

Para executar e otimizar modelos de IA em ambientes de servidores individuais

O Red Hat Enterprise Linux® AI é uma plataforma para executar Large Language Models (LLMs) em ambientes de servidores individuais.

Como começar a usar o Red Hat AI

Introdução aos AI quickstarts

Exemplos de negócios hands-on para ajudar clientes atuais da Red Hat.

Maior vantagem competitiva no setor aéreo

Com o Red Hat AI, a Turkish Airlines conseguiu colocar mais de 60 modelos em produção.

A Hitachi operacionalizou a IA em todos os negócios.

O Denizbank acelerou o time to market de dias para minutos.

A JCCM aprimorou os processos de avaliação de impacto ambiental (EIA) da região usando IA.

Red Hat AI Factory with NVIDIA

O Red Hat AI Factory with NVIDIA combina os recursos integrados da plataforma de IA do Red Hat AI Enterprise com a rede e computação acelerada da NVIDIA e o software NVIDIA AI Enterprise. Com essa solução de engenharia conjunta, as equipes podem personalizar, gerenciar e escalar modelos de produção com confiabilidade e eficiência de nível empresarial.

Mais parceiros de IA. Mais caminhos a seguir.

Os experts e as tecnologias se juntam para nossos clientes fazerem mais com a IA. Diversos parceiros de tecnologia estão trabalhando com a Red Hat para obter a certificação de compatibilidade com nossas soluções.

Casos de sucesso com a IA no Red Hat Summit e AnsibleFest 2025

Turkish Airlines dobrou a velocidade de implantação com acesso a dados de toda a empresa.

A JCCM aprimorou os processos de avaliação de impacto ambiental (EIA) da região usando IA.

O Denizbank acelerou o time to market de dias para minutos.

A Hitachi operacionalizou a IA em todos os negócios com o Red Hat OpenShift AI.

Desenvolva seus negócios em uma base confiável

Empresas ao redor do mundo confiam em nosso amplo portfólio de infraestrutura de nuvem híbrida, serviços de aplicação, desenvolvimento de aplicações nativas em nuvem e soluções de automação para oferecer serviços de TI em qualquer infraestrutura, com mais rapidez e menores custos.

Red Hat Enterprise Linux

Ofereça suporte a implantações de aplicações em um ambiente operacional flexível, seja ele on-premise, na nuvem ou na edge.

Red Hat OpenShift

Crie e implante aplicações rapidamente e em escala, modernizando as soluções que você já tem.

Red Hat Ansible

Automation Platform

Automation Platform

Crie, gerencie e escale a automação em toda a empresa, dinamicamente.

Red Hat AI

Ajuste modelos pequenos com dados relevantes. Desenvolva e implante soluções de IA em ambientes de nuvem híbrida.

Confira mais recursos de IA

Como começar a usar a IA na empresa

Use a Red Hat Consulting para IA

Red Hat Consulting: base para a plataforma de IA

Fale com um especialista da Red Hat sobre o Red Hat AI

1 Estudo da Forrester Consulting, patrocinado pela Red Hat. "Forrester: Total Economic Impact™ of Red Hat AI". Fevereiro de 2026.