-

Productos y documentación Red Hat AI

Una plataforma de productos y servicios para el desarrollo y la implementación de la inteligencia artificial en la nube híbrida.

Red Hat AI Enterprise

Diseña, desarrolla e implementa aplicaciones impulsadas por la inteligencia artificial en la nube híbrida.

Red Hat AI Inference Server

Optimiza el rendimiento de los modelos con vLLM para realizar inferencias rápidas y rentables según sea necesario.

Red Hat Enterprise Linux AI

Desarrolla, prueba y ejecuta modelos de inteligencia artificial generativa con funciones de inferencia optimizadas.

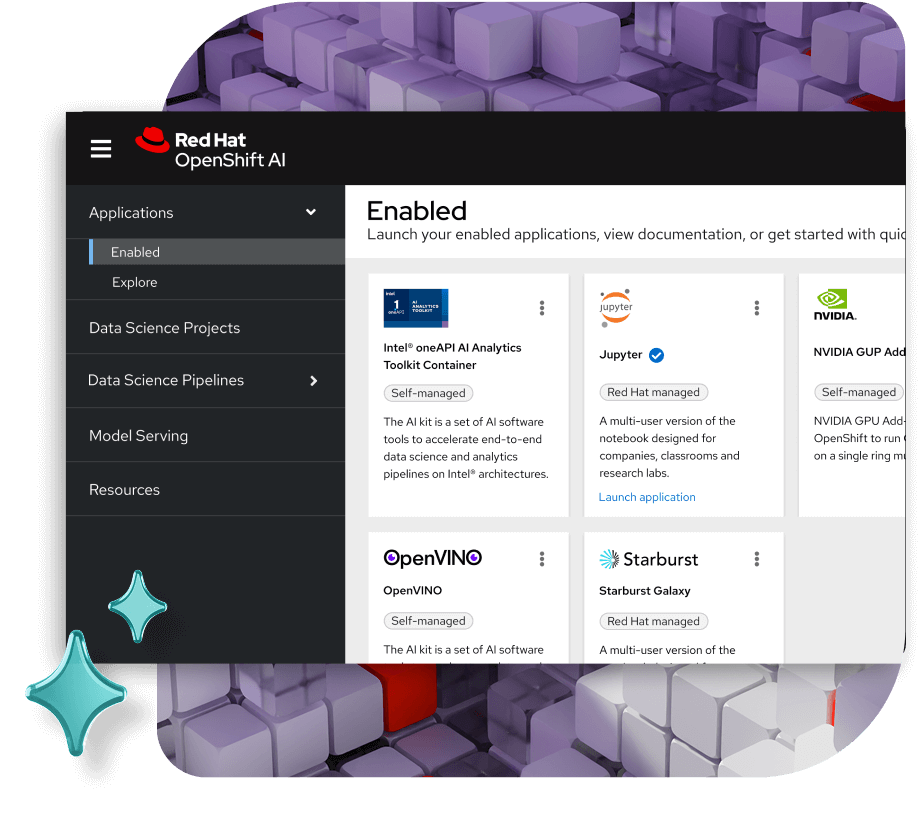

Red Hat OpenShift AI

Diseña e implementa aplicaciones y modelos con inteligencia artificial según sea necesario en entornos híbridos.

-

Recursos de aprendizaje Conceptos básicos

- Novedades de Red Hat AI

- Why you should care about AI inference

- ¿Qué son los vLLM?

- ¿Qué es la inferencia de la inteligencia artificial?

- La IA predictiva y la IA generativa

- ¿Qué es la IA con agentes?

- Mira el video RAG vs. fine-tuning

- Más información sobre la inteligencia artificial

- Todas las publicaciones de blog sobre inteligencia artificial

Casos prácticos de los productos

-

Partners de IA

Modelos validados por Red Hat AI

Los modelos validados por Red Hat® AI ofrecen confiabilidad, flexibilidad y capacidad de predicción a la hora de implementar modelos de inteligencia artificial generativa de terceros en la plataforma de Red Hat AI.

¿Por qué estos modelos validados son tan especiales?

Con tantos modelos de lenguaje de gran tamaño (LLM), configuraciones de servidores de inferencia y opciones de aceleradores de hardware, es difícil encontrar la combinación adecuada de rendimiento, precisión y costo para tu caso práctico.

Gracias a las actualizaciones más recientes de Red Hat AI 3.3, nuestro conjunto de modelos validados facilita la elección. Nuestro repositorio de modelos de terceros está validado para ejecutarse de manera eficiente en la plataforma Red Hat AI, y ahora incluye un nuevo lote de modelos de alto rendimiento.

Los modelos nuevos, como IBM Granite 4 y Apertus 8B, priorizan la transparencia y la capacidad de auditoría. Mistral Large 3 ayuda a quienes necesitan soberanía de los datos en Europa. Además, los modelos Nemotron de NVIDIA garantizan el máximo rendimiento para los clientes que prefieren la infraestructura de NVIDIA.

Funciones y ventajas de los modelos validados por Red Hat AI

Mayor flexibilidad

Accede al conjunto de modelos validados y optimizados listos para la inferencia, que se alojan en Hugging Face, para agilizar la obtención de resultados, impulsar la uniformidad y aumentar la confiabilidad de tus aplicaciones de inteligencia artificial.

Inferencia optimizada

Optimiza tu infraestructura de inteligencia artificial eligiendo el modelo, la configuración de implementación y los aceleradores de hardware adecuados para implementar modelos según los casos prácticos de tu empresa de manera rentable y eficiente.

Mayor confianza

Accede a indicadores del sector, evaluaciones de precisión y herramientas de optimización de modelos para analizar, comprimir y validar modelos de terceros en varios casos de implementación.

Aprovecha al máximo tus modelos de IA

La validación de modelos de Red Hat AI se lleva a cabo con herramientas open source como GuideLLM, Language Model Evaluation Harness y vLLM para garantizar la capacidad de replicación a los clientes.

Modelos validados

No se trata de cualquier LLM. Hemos probado distintos modelos de terceros con simulaciones realistas para comprender exactamente su comportamiento verdadero. Utilizamos herramientas especializadas para evaluar el rendimiento de los LLM en una amplia variedad de hardware.

- GuideLLM evalúa el rendimiento y los costos en varios sistemas de hardware.

- LM Evaluation Harness prueba la generalización de los modelos en distintas tareas.

Modelos optimizados

Comprimidos para obtener mayor velocidad y eficiencia. Estos LLM están diseñados para ejecutarse más rápido y utilizar menos recursos sin comprometer la precisión a la hora de implementarse en vLLM.

- LLM Compressor es una biblioteca open source que incluye las investigaciones más recientes en materia de compresión de modelos en una única herramienta, lo que permite generar fácilmente modelos comprimidos casi sin esfuerzo.

- vLLM es el principal motor open source de inferencia y de puesta a disposición de modelos de alto rendimiento y uso eficiente de la memoria para los LLM optimizados.

Desarrolla las soluciones que necesitas con Red Hat AI

Red Hat AI es la plataforma open source de inteligencia artificial que trabaja del mismo modo que lo haces tú. Reduce los costos con modelos eficientes, personalízalos con tus datos y tu experiencia en el área, e implementa y gestiona las cargas de trabajo de manera uniforme en cualquier infraestructura. Hazlo con herramientas diseñadas para ayudar a tus equipos a colaborar entre sí y adaptarse a los cambios.

Preguntas frecuentes

¿Dónde se pueden encontrar los modelos validados?

Los modelos validados están disponibles en Red Hat AI Ecosystem Catalog y en el repositorio de Red Hat AI en Hugging Face. Este último incluye la información completa de los modelos, los pesos de SafeTensor y los comandos para las implementaciones rápidas en Red Hat AI Inference Server, RHEL AI y Red Hat OpenShift AI.

¿Con qué frecuencia se agregan nuevos modelos validados?

Red Hat intenta lanzar un nuevo conjunto de modelos validados por mes, siguiendo la frecuencia de lanzamientos de vLLM upstream. Red Hat se reserva el derecho de dejar de validar modelos por cualquier motivo.

¿Cómo es el ciclo de vida de los modelos validados?

Se trata de garantizar que los modelos seleccionados se validen en las versiones secundarias n+2 de vLLM, como mínimo. Es decir, para cada modelo que validemos en una versión de vLLM, nos esforzaremos por ofrecer su compatibilidad con, al menos, las dos versiones siguientes.

¿Estos modelos validados y optimizados cuentan con soporte completo del equipo de Soporte de Red Hat?

No, los modelos de terceros no cuentan con ningún tipo de soporte, protección, certificación ni garantía de Red Hat. Además, la estimación de los recursos necesarios solo sirve de orientación, no de garantía de rendimiento ni precisión. Para obtener más información sobre la licencia de un modelo específico, comunícate con el proveedor del modelo.

¿Cómo se accede a una orientación personalizada sobre aceleradores de hardware, configuraciones e implementaciones de LLM para casos prácticos empresariales?

Envía tu consulta a validated-models@redhat.com para obtener más información.