Sind Sie bereit, Ihre KI-Einführung zu beschleunigen? KI-Schnellstarts sind nun offiziell verfügbar!

KI-Schnellstarts sind ein neuer Katalog mit einsatzbereiten, branchenspezifischen Use Cases, mit denen Sie die Leistungsfähigkeit von Open Source-KI direkt nutzen können. Sie dienen als Testumgebung, in der Sie Red Hat AI beherrschen und die Kompetenzen erweitern können, die Sie benötigen, um Ihre KI-Ideen von der Experimentierphase in die Produktion zu überführen. Jeder KI-Schnellstart ist so konzipiert, dass Sie ihn einfach bereitstellen, erkunden und erweitern können, sodass Sie und Ihr Team schnell und praxisnah erfahren, wie KI reale Lösungen auf einer unternehmensfähigen Open Source-Infrastruktur unterstützen kann.

Wir glauben, dass der beste Weg, sich auf die Zukunft der KI vorzubereiten, in praktischer Erfahrung liegt. Schluss mit dem leeren Blatt – tauchen Sie ein in diese konkreten Use Cases und verwandeln Sie ein „Was wäre, wenn“ in ein „Was kommt als Nächstes“.

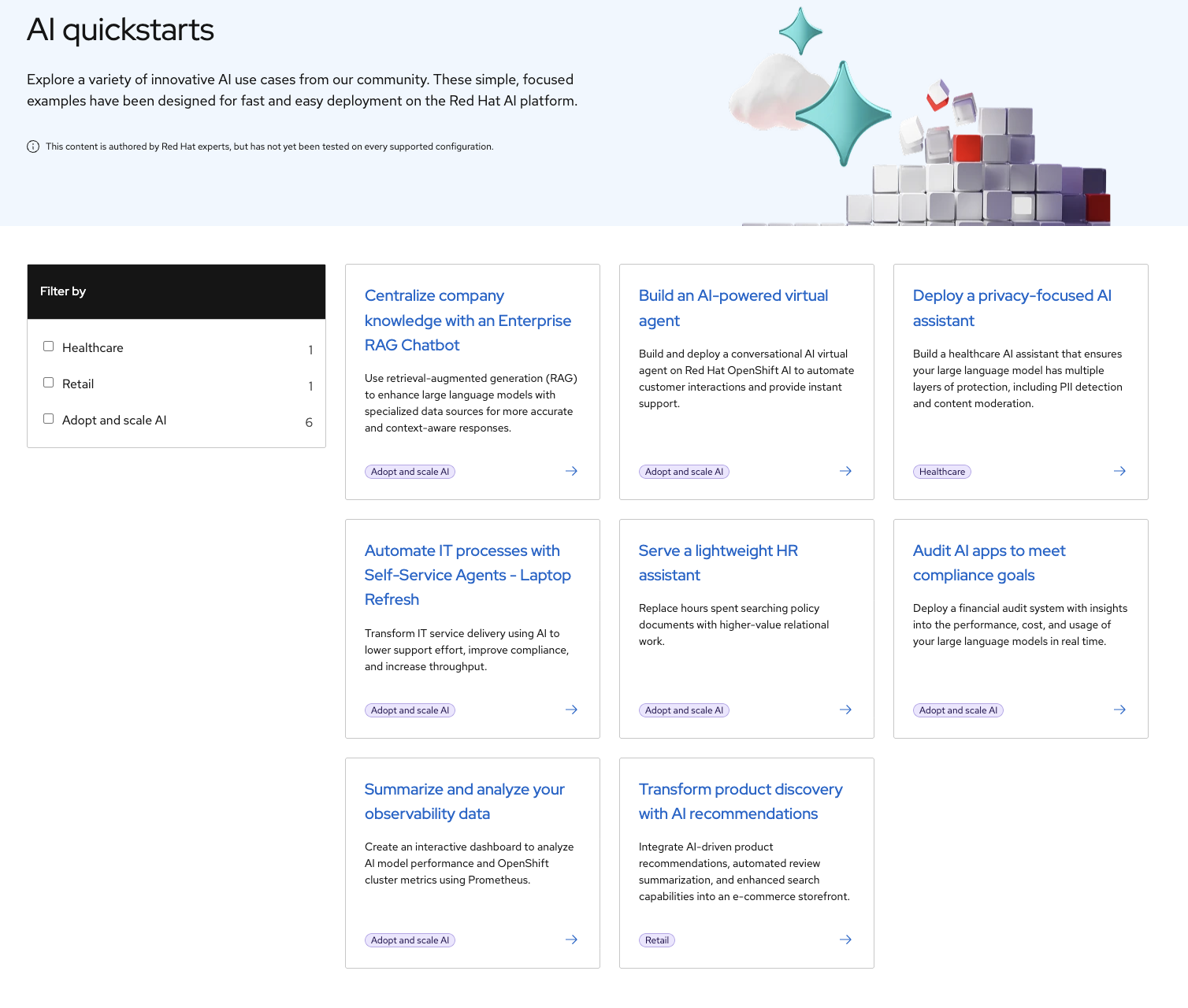

Abbildung 1: Vorschau auf den KI-Schnellstart-Katalog

Lassen Sie uns loslegen! Besuchen Sie zunächst den KI-Schnellstart-Katalog, der Ihnen interessante Use Cases bietet. Betrachten Sie beispielsweise den Schnellstart „Deploy a privacy-focused AI assistant“. Es demonstriert, wie sich vertrauliche Daten im Gesundheitswesen identifizieren und schützen lassen. Wenn Sie auf das Beispiel klicken, erhalten Sie weitere Details zum Use Case, einschließlich Mindestanforderungen und Installationsanweisungen. Dieser KI-Schnellstart lohnt sich auch dann, wenn Sie nicht mit Patientendaten arbeiten. Er zeigt eine einfache und effektive Möglichkeit zum Schutz sensibler Daten in Ihrem Unternehmen, unabhängig von der Art dieser Daten.

Wenn der KI-Schnellstart im Gesundheitswesen nicht auf Ihren Use Case zugeschnitten ist, bieten wir Ihnen eine wachsende Liste an. Weitere Beispiele:

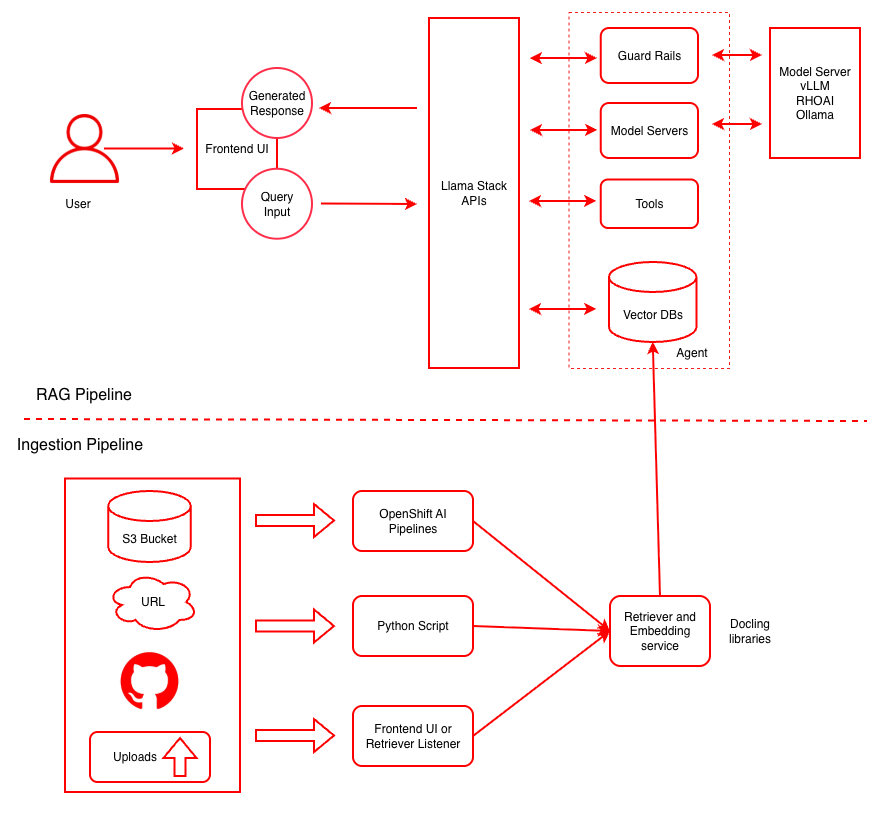

- Centralize company knowledge with an Enterprise RAG Chatbot: Dieser KI-Schnellstart zeigt, wie Sie mithilfe von Retrieval-Augmented Generation (RAG) Modelle mit unternehmensspezifischen Datastores verbessern können, um genauere und kontextbewusstere Antworten zu erhalten.

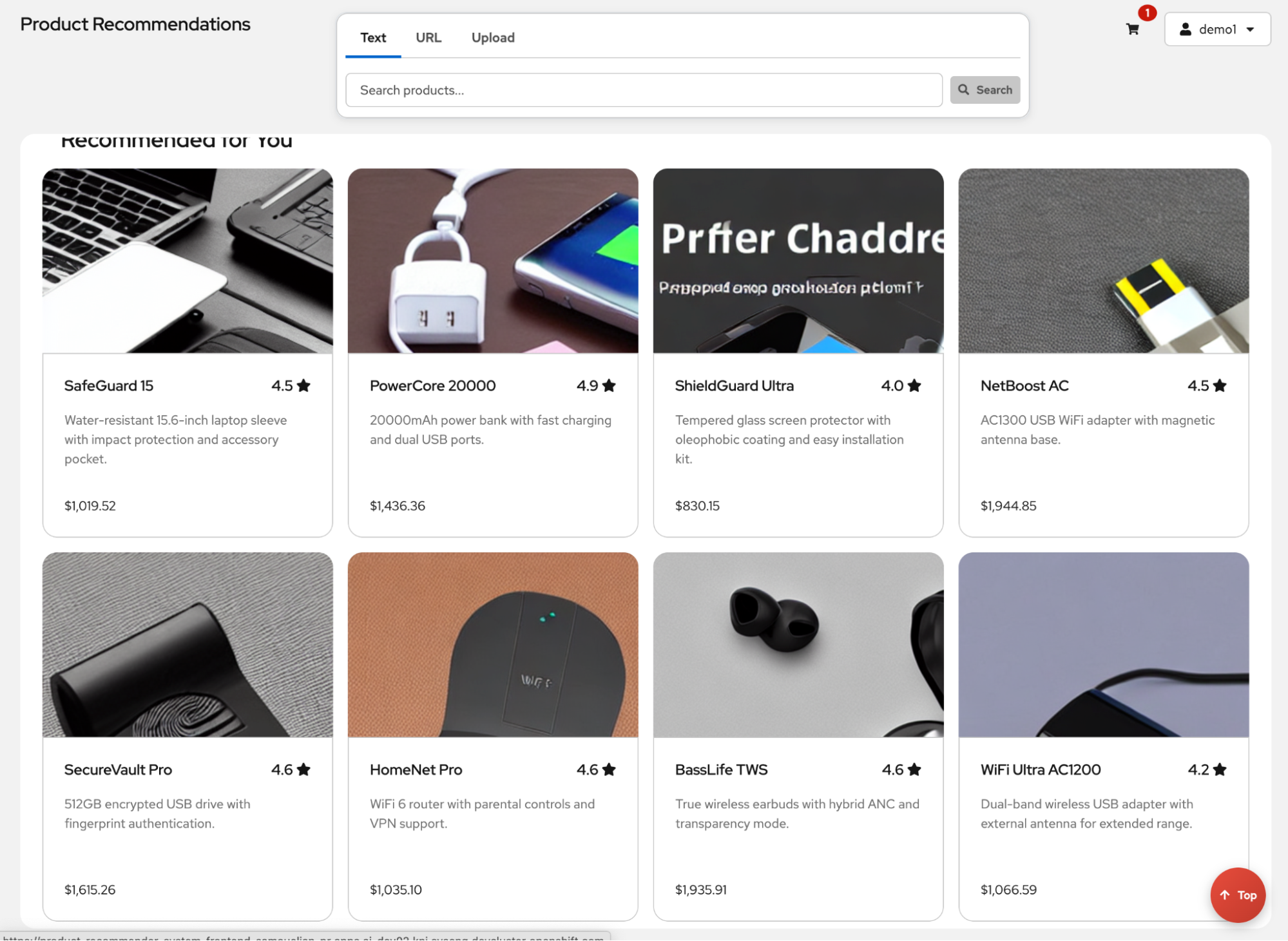

- Transform product discovery with AI recommendations: Erfahren Sie, wie Sie KI-gesteuerte Produktempfehlungen und automatisierte Bewertungszusammenfassungen in einen E-Commerce-Shop integrieren können.

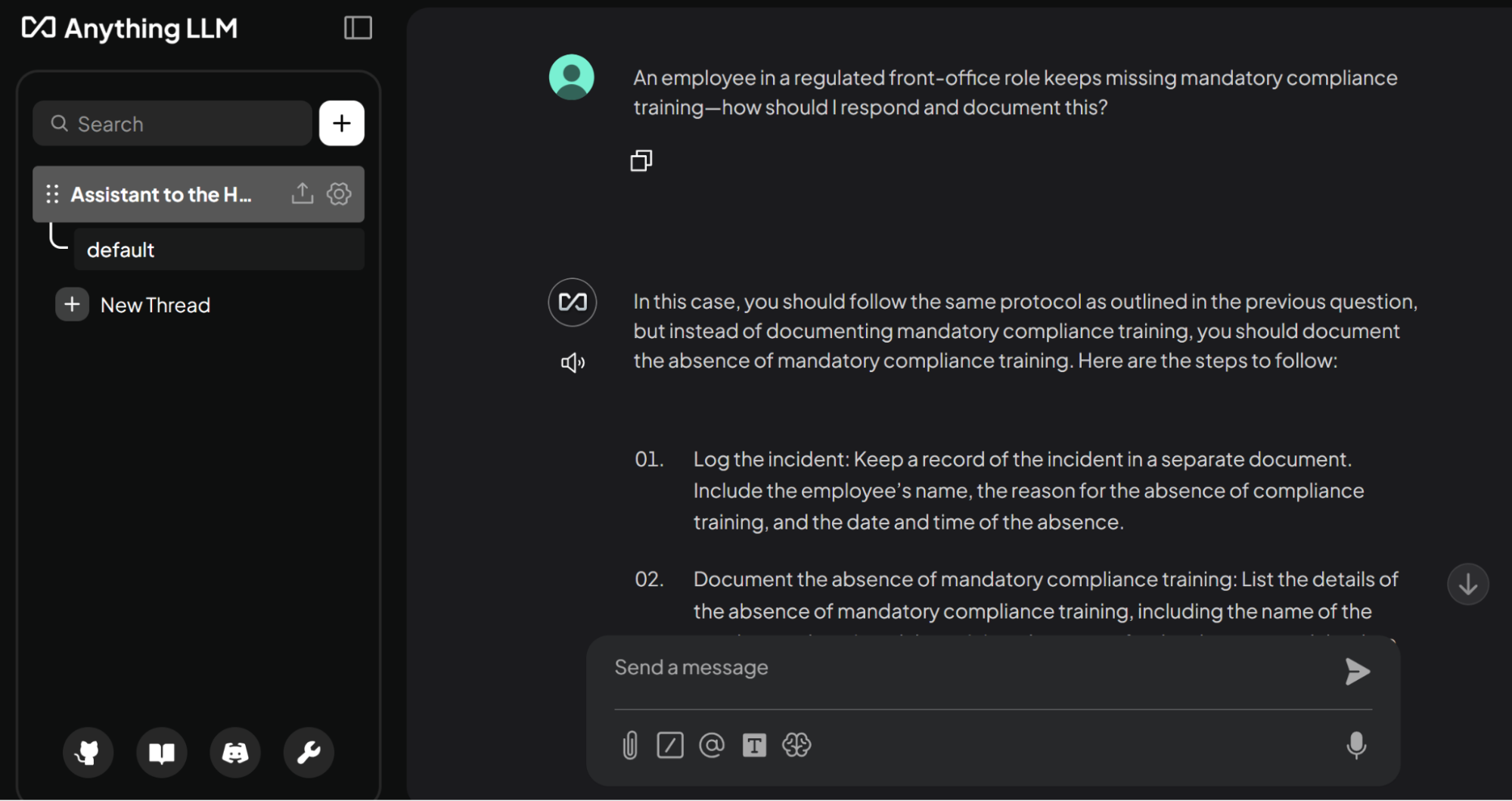

- Serve a lightweight HR assistant Dieser Chatbot hilft, Stunden einzusparen, die normalerweise für die Suche nach Richtliniendokumenten aufgewendet werden, sodass sich das Team in der Personalabteilung auf wichtigere geschäftliche Aufgaben konzentrieren kann.

Abbildung 2: Architekturdiagramm „Centralize company knowledge with an enterprise RAG chatbot“

Abbildung 3: Screenshot des KI-Schnellstarts „Transform product discovery with AI recommendations“

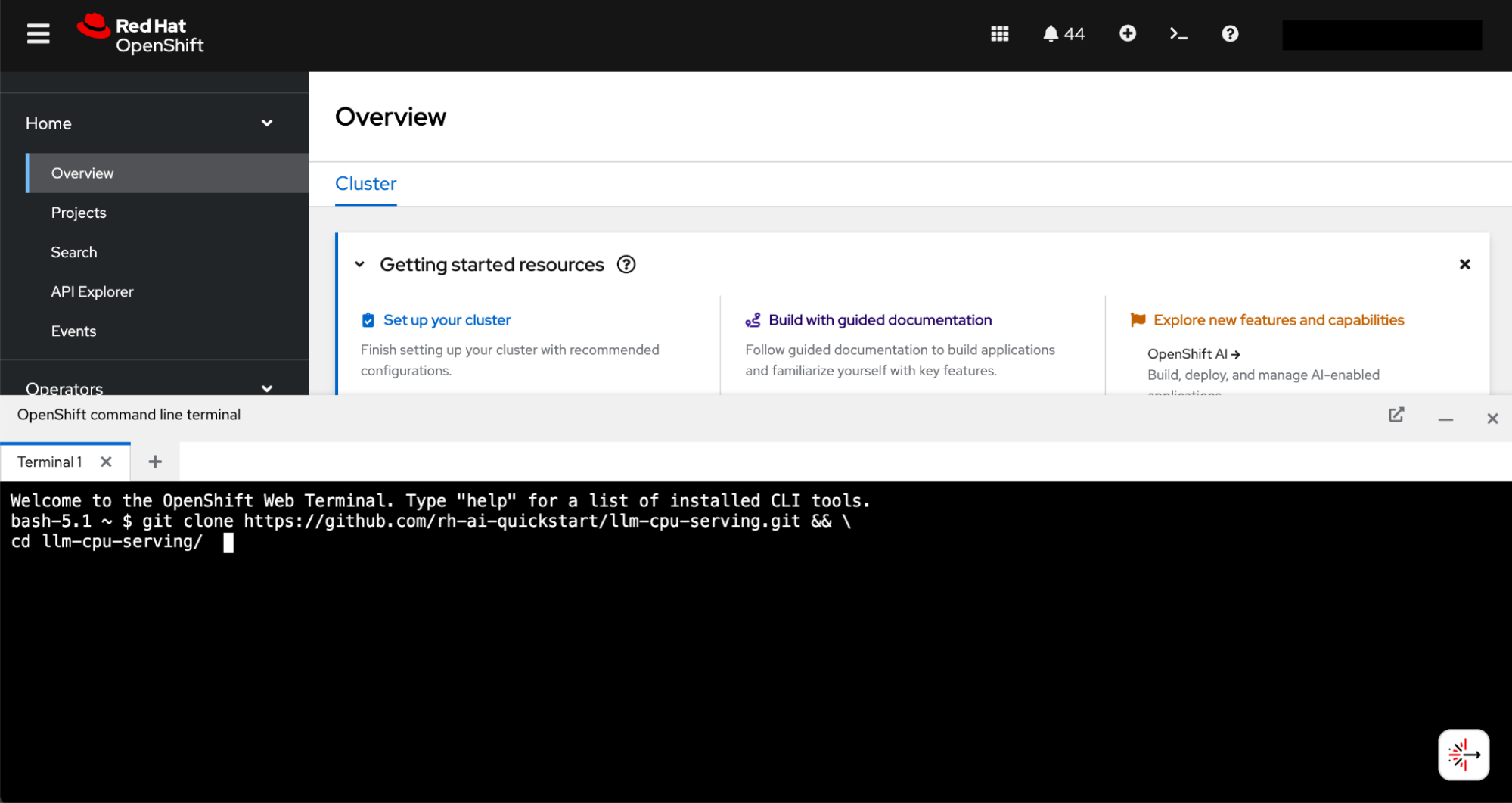

Der KI-Schnellstart „Serve a lightweight HR assistant“ ist besonders interessant, da er sich ohne GPUs oder spezielle Hardware bereitstellen lässt. Er führt TinyLlama auf der CPU aus, sodass Nutzende ihn für den Einstieg in Red Hat OpenShift AI nutzen können. Lassen Sie uns den HR-Assistenten gemeinsam bereitstellen:

- Navigieren Sie zum Abschnitt „Deploy“ des Schnellstarts, und folgen Sie den Anweisungen.

- Öffnen Sie in einem anderen Browser-Tab ein Webterminal in Ihrer Red Hat OpenShift-Umgebung. Sie können oc auch lokal verwenden, wenn Sie möchten.

- Klonen Sie einfach das Repository, und ändern Sie die Verzeichnisse.

git clone https://github.com/rh-ai-quickstart/llm-cpu-serving.git && \ cd llm-cpu-serving/

Abbildung 4: Stellen Sie Ihren ersten KI-Schnellstart in Red Hat OpenShift bereit

- Erstellen Sie ein neues Projekt.

PROJECT="hr-assistant" oc new-project ${PROJECT}- Und dann installieren Sie.

helm install llm-cpu-serving helm/ --namespace ${PROJECT} Nach nur wenigen Befehlen können Sie zum Projekt „hr-assistant“ im OpenShift AI-Dashboard navigieren und Ihren Assistenten starten.

Abbildung 5: Anleitung aus dem KI-Schnellstart „Serve a lightweight HR assistant“

Wie wir KI-Schnellstarts entwickeln und unsere zukünftigen Schritte

Wir entwickeln KI-Schnellstarts basierend auf Kundenbedarf – Ihren Anforderungen und Anfragen entsprechend. Wir möchten damit sowohl den Wert als auch einen klaren Weg zu realen Ergebnissen aufzeigen. Dies erreichen wir mit konkreten und relevanten Beispielen, die von KI unterstützt werden.

Die KI-Fachleute von Red Hat, unsere Software- und Bereitstellungspartner sowie die Open Source Community haben diese Use Cases gemeinsam entwickelt. Wir arbeiten offen und laden Kunden und Partner ein, unsere neuesten KI-Schnellstarts auszuprobieren, bei der Entwicklung neuer Projekte mitzuwirken und neue KI-Schnellstart-Vorschläge einzureichen für zukünftige Entwicklungsinitiativen. Besuchen Sie unsere Einführungsseite, um mehr zu erfahren.

Wenn Sie einfach loslegen möchten, sind Sie auf der Katalogseite für KI-Schnellstarts genau richtig. Sie enthält auch eine Liste unserer beliebtesten KI-Schnellstarts, damit Sie sie leichter finden können. Natürlich wird unser Katalog in Zukunft weiter wachsen, da wir neue KI-Schnellstarts entwickeln und veröffentlichen.

Der wahre Wert von KI liegt in ihrer Fähigkeit, reale geschäftliche Probleme zu lösen, nicht nur in ihrem technischen Potenzial. Indem Ihr Team über die reine Theorie hinausgeht und sich diesen einsatzbereiten Use Cases widmet, kann es aufhören zu experimentieren und greifbare Ergebnisse auf der bewährten, offenen Basis von Red Hat AI liefern.

Starten Sie noch heute mit KI-Schnellstarts.

Mehr erfahren

- Verwandeln Sie mit diesem KI-Schnellstart komplexe Metriken in umsetzbare Erkenntnisse

- Blog: Oracle MCP Server auf OpenShift in Kombination mit Red Hat AI Virtual Agent

- Mit Red Hat OpenShift AI eine KI-gestützte Produktempfehlung entwickeln

- Von manuell bis agentisch: Optimierung von IT-Prozessen mit Red Hat OpenShift AI

Ressource

Das adaptive Unternehmen: KI-Bereitschaft heißt Disruptionsbereitschaft

Über den Autor

Karl Eklund is a Principal Architect aligning customer goals to solutions provided by the open source community and commercial vendors within the Red Hat OpenShift Data Science platform. Prior to joining Red Hat, Karl advised technology leaders on enterprise data and technology strategies and built machine learning models across multiple academic disciplines.

Ähnliche Einträge

From experiment to production: A reliable architecture for version-controlled MLOps

AI security: Defending against prompt injection and unsafe actions

Technically Speaking | Build a production-ready AI toolbox

Technically Speaking | Platform engineering for AI agents

Nach Thema durchsuchen

Automatisierung

Das Neueste zum Thema IT-Automatisierung für Technologien, Teams und Umgebungen

Künstliche Intelligenz

Erfahren Sie das Neueste von den Plattformen, die es Kunden ermöglichen, KI-Workloads beliebig auszuführen

Open Hybrid Cloud

Erfahren Sie, wie wir eine flexiblere Zukunft mit Hybrid Clouds schaffen.

Sicherheit

Erfahren Sie, wie wir Risiken in verschiedenen Umgebungen und Technologien reduzieren

Edge Computing

Erfahren Sie das Neueste von den Plattformen, die die Operations am Edge vereinfachen

Infrastruktur

Erfahren Sie das Neueste von der weltweit führenden Linux-Plattform für Unternehmen

Anwendungen

Entdecken Sie unsere Lösungen für komplexe Herausforderungen bei Anwendungen

Virtualisierung

Erfahren Sie das Neueste über die Virtualisierung von Workloads in Cloud- oder On-Premise-Umgebungen