Wie die Open-Source-Lösung Kargo Transparenz und Steuerbarkeit in mehrstufige Deployment-Prozesse bringt

In vielen Unternehmen gelten GitOps und Kubernetes inzwischen als etablierte Standards für den Applikationsbetrieb. Red Hat OpenShift oder Kubernetes Cluster sind nach Best Practices aufgesetzt und Continuous-Integration-Pipelines erzeugen Images sicher und reproduzierbar. Der Rollout erfolgt über Argo CD oder vergleichbare GitOps-Operatoren.

In der Theorie ist damit alles geklärt: Applikationskonfigurationen liegen im Git, Stages und Naming-Konventionen sind definiert und der gewünschte Zielzustand ist sauber beschrieben. In der Praxis entstehen jedoch genau an dieser Stelle Lücken. Vor allem bleibt offen, wie eine neue Version kontrolliert und nachvollziehbar von einer Stage in die nächste wechselt. GitOps beschreibt deklarativ den Endzustand, nicht den Weg dorthin. Abhängigkeiten, fachliche Freigaben, Mandantenkontexte oder unterschiedliche Qualitätsanforderungen der einzelnen Stages werden dadurch nicht ausreichend abgebildet.

Mit wachsender Komplexität der Anwendungslandschaft wird das Defizit sichtbar. Es entstehen zusätzliche Stages, zum Beispiel für Integrationstests oder mandantenspezifische Abnahmen. In produktionsnahen Umgebungen sind zudem oft Freigaben durch Applikationsverantwortliche nötig. Diese entscheiden zwar, kennen die GitOps-Mechanismen aber nicht im Detail. Parallel entstehen individuelle Workarounds: Manuelle Skripte, separate CI-Jobs oder Sonderlösungen in einzelnen Teams übernehmen Promotion-Schritte. Häufig fehlen dabei aber eine zentrale Dokumentation und Standards.

Genau hier setzt Kargo an. Die Open-Source-Lösung ergänzt bestehende GitOps-Set-ups um eine klare Promotion-Schicht. Sie trennt Build, Promotion und Sync sauber voneinander. Continuous Integration (zum Beispiel mit Tekton, GitLab CI oder GitHub Actions) erzeugt neue Applikationsstände und Kargo übernimmt die Promotion von einer Stage zur nächsten. Anschließend synchronisieren Argo CD oder ein anderes GitOps-Werkzeug den gewünschten Zustand ins Cluster. Git bleibt dabei die maßgebliche Quelle der Wahrheit, wobei jede Änderung an einer Zielumgebung über nachvollziehbare Commits erfolgt. Kargo orchestriert den Ablauf und automatisiert die nötigen Promotion-Schritte.

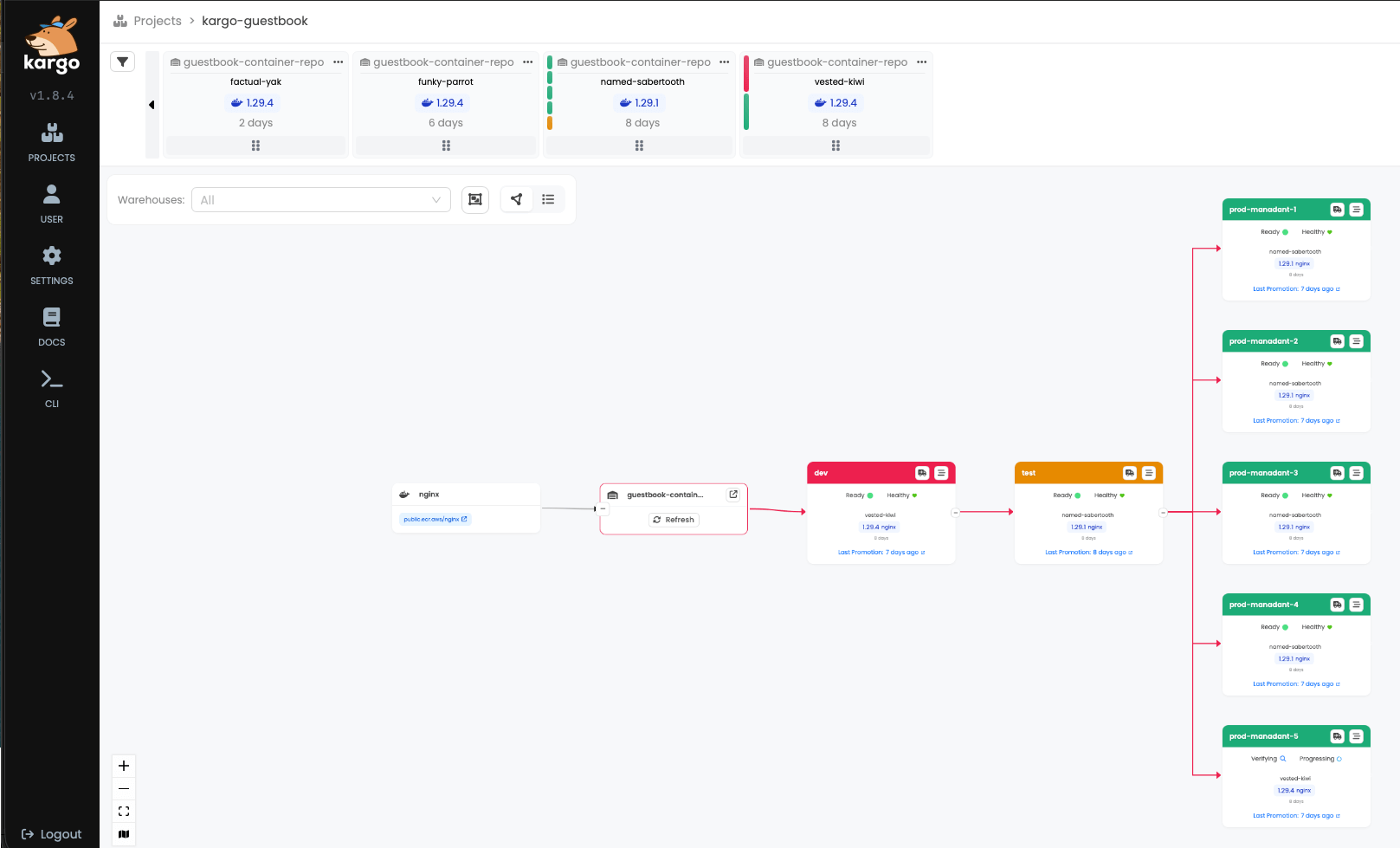

Kargo führt eigene Domänenobjekte ein, die den Promotion-Prozess klar strukturieren. Das „Warehouse“-Objekt beobachtet Quellen wie Container-Registries, Git-Repositories oder Helm-Repositories und erkennt neue Versionen. Diese werden als „Freight“-Objekte modelliert – also als konkret auslieferbare Versionen mit Metadaten wie Herkunft, Version und Status. „Stage“-Objekte stehen für Zielumgebungen wie Dev, Test, Preprod oder Prod. Sie enthalten Regeln, Promotion-Aufgaben und optional eine Verifikationslogik. Wird eine neue Freight erkannt, kann sie nach definierten Regeln durch die Stages wandern.

Abbildung 1: Kargo-Dashboard einer Beispiel-Applikation mit deren Stages (Quelle: adesso)

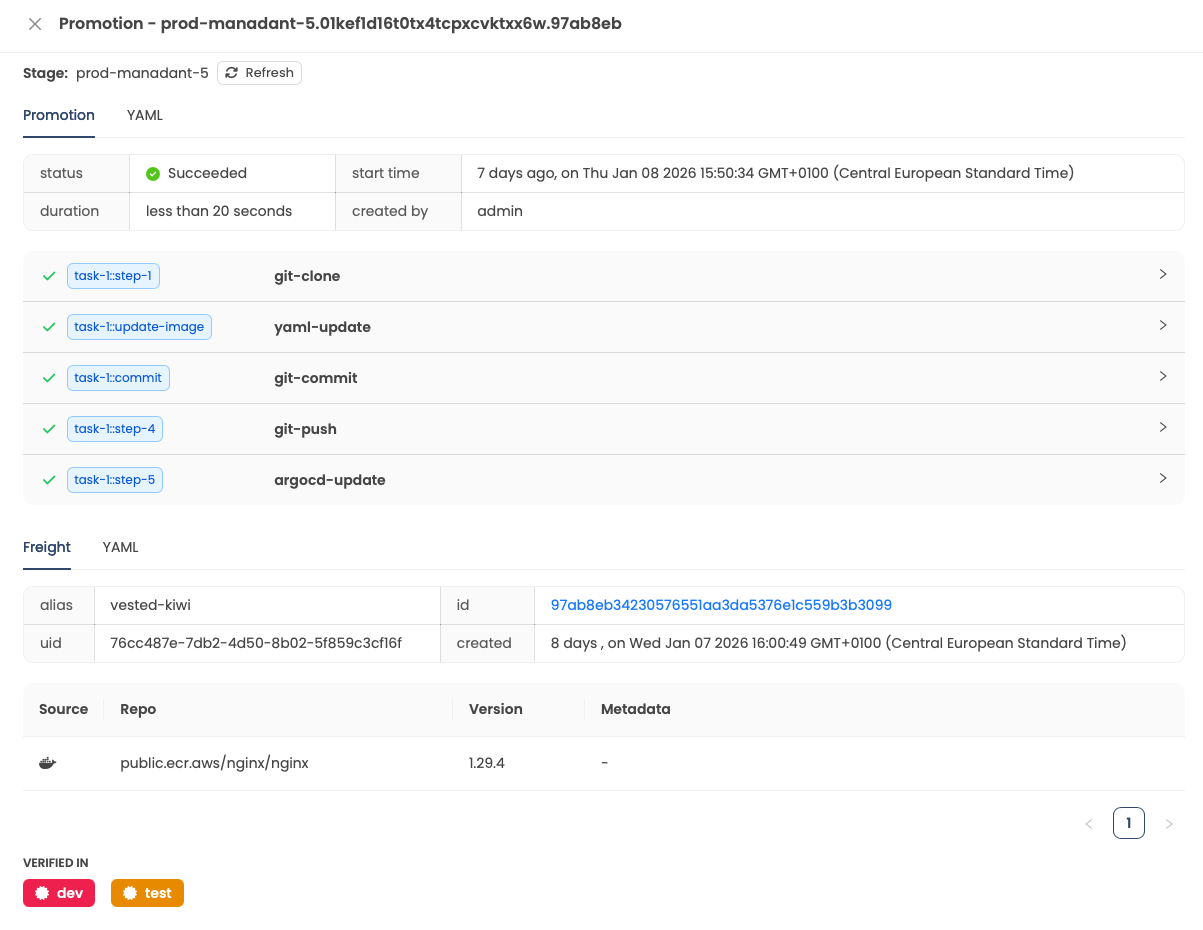

Der Mehrwert entsteht durch konfigurierbare Promotion-Tasks und -Steps. Statt individuelle Skripte zu pflegen, nutzen Teams vordefinierte Bausteine, die sich parametrieren und wiederverwenden lassen. Typische Beispiele sind Git-Operationen (Klonen, Anpassen von YAML/JSON, Commit und Push), das Aktualisieren von Image-Tags für eine Zielumgebung oder das Auslösen externer Integrationen über HTTP-APIs. Dazu gehören etwa das Erstellen eines Tickets in einem ITSM-Tool oder das Triggern zusätzlicher Pipelines. So lassen sich standardisierte Promotion-Pfade etablieren, ohne individuelle Anforderungen zu blockieren. Management- und Plattform-Teams erhalten eine durchgängige Sicht: Welche Version läuft in welcher Stage, und welche Qualitäts- oder Freigabeschritte wurden bereits erfolgreich durchlaufen?

Abbildung 2: Beispiel Promotion-Steps für eine Produktionsumgebung in Kargo (Quelle: adesso)

Ein zentraler Baustein ist die Verifikation. Nach der Promotion in eine Stage können automatisierte Tests oder Metrik-basierte Checks den Rollout prüfen. Kargo integriert sich dafür eng mit Argo Rollouts und nutzt definierte Kennzahlen, um zu entscheiden, ob eine Version als erfolgreich verifiziert gilt. Erst dann wird sie für die nächste Stage freigegeben. So entsteht ein kontrollierter, wiederholbarer Flow: von der Erstellung einer neuen Version über ihre schrittweise Verteilung bis hin zur finalen Produktion – ohne zusätzliche proprietäre Orchestrierungen.

Kargo folgt konsequent Kubernetes-Prinzipien. Konfigurationen liegen als Custom Resource im Cluster und können GitOps-konform verwaltet werden. Das erleichtert Integration, Betrieb und Weiterentwicklung: Promotion-Logik ist versioniert, prüfbar sowie auditierbar und fügt sich nahtlos in Infrastructure-as-Code-Ansätze ein. Kargo ergänzt damit den bestehenden GitOps-Werkzeugkasten und lässt sich ohne grundlegende Änderungen an vorhandenen CI/CD-Landschaften einführen.

Insgesamt schließt Kargo eine zentrale Lücke moderner GitOps-Architekturen. Damit wird der bisher „unsichtbare“ Weg zwischen Stages explizit, automatisierbar und auditierbar. Promotion-Logik liegt nicht mehr in individuellen Pipelines, Skripten oder manuellen Workflows. Stattdessen gibt es einen standardisierten, sichtbaren und steuerbaren Prozess. Das erhöht die Transparenz über den Reifegrad einer Version. Governance-Vorgaben lassen sich besser einhalten und fachliche Freigaben sind klar von der technischen Umsetzung getrennt. Gleichzeitig bleibt die Automatisierung hoch. In einem Umfeld mit steigender Release-Frequenz und wachsenden Compliance-Anforderungen bietet Kargo somit einen pragmatischen, Open-Source-basierten Weg. So werden GitOps-Deployments dauerhaft professioneller.

Über den Autor

Ähnliche Einträge

enclaive vHSM: Der Schlüssel zu sicheren Cloud-Infrastrukturen

Building the foundation for an AI-driven, sovereign future with Red Hat partners

Bringing Deep Learning to Enterprise Applications | Code Comments

Transforming Your Identity Management | Code Comments

Nach Thema durchsuchen

Automatisierung

Das Neueste zum Thema IT-Automatisierung für Technologien, Teams und Umgebungen

Künstliche Intelligenz

Erfahren Sie das Neueste von den Plattformen, die es Kunden ermöglichen, KI-Workloads beliebig auszuführen

Open Hybrid Cloud

Erfahren Sie, wie wir eine flexiblere Zukunft mit Hybrid Clouds schaffen.

Sicherheit

Erfahren Sie, wie wir Risiken in verschiedenen Umgebungen und Technologien reduzieren

Edge Computing

Erfahren Sie das Neueste von den Plattformen, die die Operations am Edge vereinfachen

Infrastruktur

Erfahren Sie das Neueste von der weltweit führenden Linux-Plattform für Unternehmen

Anwendungen

Entdecken Sie unsere Lösungen für komplexe Herausforderungen bei Anwendungen

Virtualisierung

Erfahren Sie das Neueste über die Virtualisierung von Workloads in Cloud- oder On-Premise-Umgebungen