-

製品とドキュメント Red Hat AI

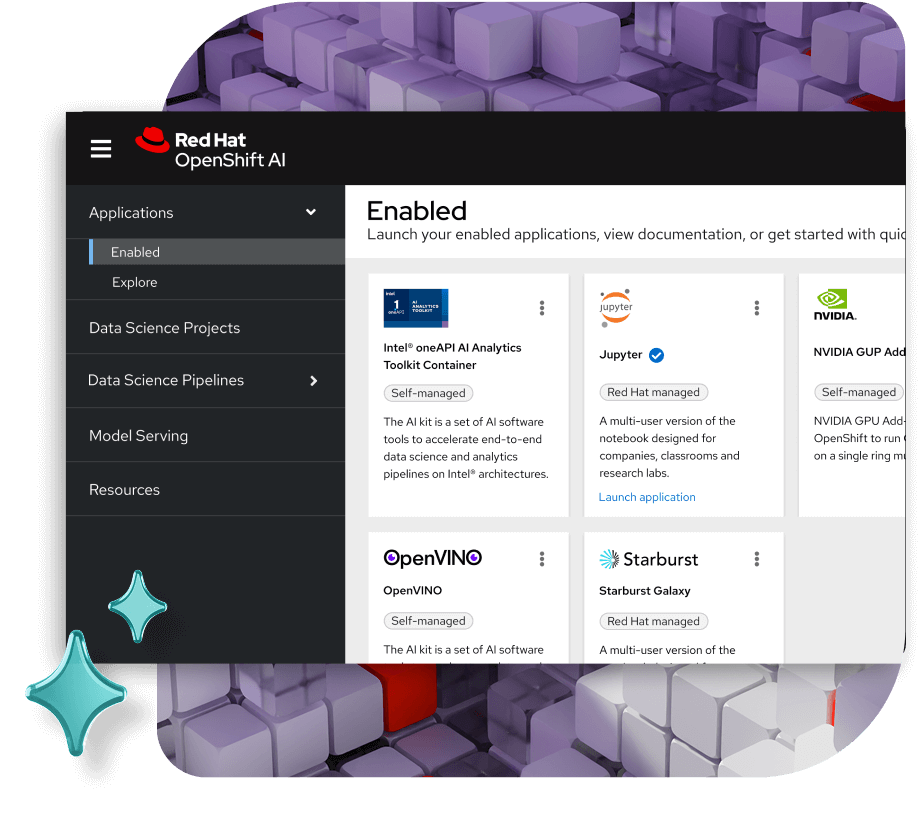

ハイブリッドクラウドで AI の開発とデプロイを行うための製品およびサービスのプラットフォーム。

Red Hat AI Enterprise

AI を活用したアプリケーションをハイブリッドクラウドのどこででも構築、開発、デプロイします。

-

学ぶ 基本

-

AI パートナー

Red Hat AI による検証済みモデル

Red Hat® AI による検証済みモデルは、Red Hat AI プラットフォームにサードパーティの生成 AI モデルをデプロイする際の信頼性、予測可能性、柔軟性を提供します。

概要

大規模言語モデル (LLM)、推論サーバーの設定、ハードウェア・アクセラレーターの選択肢は数多く存在するため、想定するユースケースにおけるパフォーマンス、精度、およびコストの間で適切なバランスを取るには、ニーズに最適な組み合わせを慎重に評価する必要があります。

これをサポートするため、Red Hat AI は、このプラットフォームで効率的に動作することがすでに検証されている、サードパーティモデルのリポジトリへのアクセスを提供しています。これらの優れたサードパーティモデルは、容量に関するガイダンス計画のシナリオを通じて実行されるため、自社の分野に特化したユースケースに適したモデル、デプロイメント設定、ハードウェア・アクセラレーターの組み合わせについて、情報に基づいた決定を下すことができます。

特長とメリット

柔軟性の向上

すぐに推論に使用できる検証済みモデルと最適化済みモデル (Hugging Face でホストされている) が集められており、価値実現までの時間の短縮、一貫性の促進、AI アプリの信頼性向上を実現できます。

最適化された推論

適切なモデル、デプロイメント設定、ハードウェア・アクセラレーターを選択して AI インフラストラクチャを最適化し、ユースケースに合わせたコスト効率の高い、効率的なデプロイメントを実現します。

信頼性の向上

さまざまなデプロイメントシナリオにおいてサードパーティモデルを評価、圧縮、検証するための業界ベンチマーク、精度評価、モデル最適化ツールにアクセスできます。

モデルを最大限に活用する

Red Hat AI のモデル検証は、お客様側での再現性が得られるよう、GuideLLM、Language Model Evaluation Harness、vLLM などのオープンソースツールを使用して行われます。

検証済みモデル

これらは単なる LLM ではありません。Red Hat は実環境におけるパフォーマンスを正確に把握できるよう、サードパーティモデルを現実的なシナリオでテストしています。また、専用のツールを使用して、さまざまなハードウェアにおける LLM のパフォーマンスを評価しています。

- GuideLLM は、ハードウェアのセットアップ全体のパフォーマンスとコストを評価します。

- LM Evaluation Harness は、タスク全体でのモデルの一般化をテストします。

最適化済みモデル

スピードと効率性を高めるために圧縮されています。これらの LLM は、vLLM にデプロイする際に精度を損なうことなく、より迅速に、より少ないリソースで動作するように設計されています。

- LLM Compressor は、モデル圧縮に関する最新の研究を単一のツールに組み込んだオープンソースライブラリであり、最小限の労力で簡単に圧縮モデルを生成できます。

- vLLM は優れたスループットとメモリー効率を実現する、最適化された LLM 向けの最先端のオープンソース推論およびサービスエンジンです。

Red Hat AI を使って必要なソリューションを構築

Red Hat AI は、お客様のニーズに合わせて利用できるオープンソース AI プラットフォームです。効率的なモデルによるコストの削減、自社のデータと専門知識を使ったモデルのカスタマイズ、あらゆるインフラストラクチャでの一貫したワークロードのデプロイと管理が可能です。また、チームによるコラボレーションやスケーリングを支援するためのツールもあります。

よくある質問 (FAQ)

検証済みモデルはどこにありますか。

検証済みモデルは、Red Hat AI Ecosystem Catalog および Hugging Face の Red Hat AI リポジトリで入手できます。Hugging Face の Red Hat AI リポジトリには、モデルの詳細、SafeTensor による重み付けのほか、Red Hat AI Inference Server、RHEL AI、Red Hat OpenShift AI に迅速にデプロイするためのコマンドが含まれています。

新しい検証済みモデルはどのくらいの頻度で追加されるのですか。

Red Hat では、アップストリームの vLLM のリリースサイクルに合わせて、新規の検証済みモデルを毎月リリースすることを目指しています。Red Hat は、理由を問わずモデルの検証を停止する権利を留保します。

検証済みモデルのライフサイクルはどのようになっていますか。

選定されたモデルは、少なくとも n+2 バージョン先の vLLM マイナーバージョンまで誠意を持って検証されます。vLLM バージョンで検証する各モデルについては、少なくとも次の 2 つのバージョンの vLLM に対してそのモデルの前方互換性を提供するよう努めます。

これらの検証済みモデルと最適化済みモデルは、Red Hat サポートチームが完全にサポートしていますか。

いいえ、Red Hat はサードパーティモデルのサポート、補償、認定、保証を提供しません。また、容量に関するガイダンスはあくまでガイダンスであり、パフォーマンスや精度を保証するものではありません。各モデルのライセンスの詳細については、モデルプロバイダーにお問い合わせください。

自社のユースケースに合わせてカスタマイズされた LLM のデプロイメント、構成、およびハードウェア・アクセラレーターのガイダンスを得るにはどうすればよいですか。

詳細は validated-models@redhat.com までお問い合わせください。