-

製品とドキュメント Red Hat AI

ハイブリッドクラウドでの AI の開発とデプロイのための製品およびサービスのプラットフォーム。

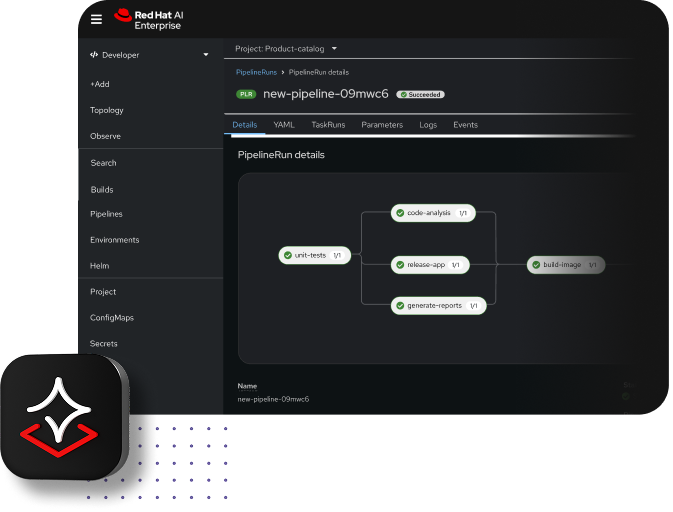

Red Hat AI Enterprise

AI を活用したアプリケーションをハイブリッドクラウドのどこででも構築、開発、デプロイします。

-

学ぶ 基本

-

AI パートナー

Red Hat AI

ハイブリッドクラウド全体のどこでも任意のハードウェア・アクセラレーター上であらゆるモデルとエージェントを実行できる信頼性の高い基盤により、エンタープライズ AI ソリューションの開発とデプロイを加速できます。

エージェント型 AI の柔軟性と効率性をさらに高める Red Hat AI の最新版

Red Hat AI 3.4 がリリースされました。

対応プラットフォームでエージェント型 AI を提供

エージェント型 AI により、AI エクスペリエンスは会話から自律型の実行へと進化します。

Red Hat® AI なら、独自のエージェントを、企業に求められるガバナンスおよび制御とともにデプロイできます。

Red Hat AI で 233% の投資対効果 (ROI)

Red Hat が委託した Forrester Consulting の調査によると、Red Hat AI をお使いのお客様をベースとした調査対象組織の全体において、Red Hat AI のデプロイによって 233% の投資対効果 (ROI) が実現していることがわかりました。1

Red Hat AI を選ぶ理由

ハイブリッドクラウド全体のどこでも任意のハードウェア・アクセラレーター上であらゆるモデルとエージェントを実行できる信頼できる基盤の上で構築できます。Red Hat AI を使うと、データ、コンプライアンス、コストの要件に合わせて、適切な場所にデプロイできる自由が得られます。

推論

vLLM を活用した高速で効率的な推論と優れた制御性でモデルの複雑さを管理し、ハイブリッドクラウドのどこでも任意のアクセラレーター上であらゆるモデルを実行できます。

データ

モデルを組織独自のプライベートデータに接続して、カスタマイズしたドメイン固有エージェント型 AI のユースケースを作成できます。

エージェント

ガバナンスと制御でエージェント型 AI 導入の成功に向けたプロセスを単純化し、加速させましょう。

プラットフォーム

オープンソースの透明性とハイブリッドクラウドのスケーラビリティを基盤として、レジリエントで信頼できる AI ソリューションをデプロイできます。

Red Hat AI に含まれるもの

Red Hat AI には、ハイブリッドクラウド全体への AI の拡張に必要な柔軟性と一貫性を提供する包括的な製品ポートフォリオが用意されています。

ハイブリッドクラウド全体での AI の構築、開発、デプロイ

Red Hat AI Enterprise は、エンタープライズグレードの機能を備えた、すぐに使用できる開発環境です。AI モデルとアプリケーションのライフサイクルを統合して、効率の向上、提供の迅速化、リスクの低減を実現します。

一貫性のある高速でコスト効率の高い推論を大規模に実現

vLLM や llm-d などのオープンソース・テクノロジーを活用している Red Hat AI Inference は、任意のモデルとアクセラレーターを使用してハイブリッドクラウド全体のどこへでも拡張できる柔軟性を提供します。

機械学習モデルのトレーニング、チューニング、デプロイ、監視

Red Hat OpenShift® の機能をベースに構築された Red Hat OpenShift AI は、ハイブリッドクラウド環境全体で予測型 AI および生成 AI モデルのライフサイクルを大規模に管理するためのプラットフォームです。

個々のサーバー環境での AI モデルの実行と最適化

Red Hat Enterprise Linux® AI は、個々のサーバー環境で大規模言語モデル (LLM) を実行するためのプラットフォームです。

航空業界における競争上の優位性を獲得

ターキッシュ エアラインズは、Red Hat AI を使用して事業全体で 60 以上のモデルをプロダクション環境に導入することができました。

日立は事業全体で AI を運用化しました。

DenizBank は、市場投入時間を数日から数分へと短縮しました。

JCCM は、AI を使用して地域の環境影響評価 (EIA) プロセスを改善しました。

Red Hat AI Factory with NVIDIA

Red Hat AI Factory with NVIDIA は、Red Hat AI Enterprise の統合 AI プラットフォーム機能と、NVIDIA の高速コンピューティング、ネットワーキング、NVIDIA AI Enterprise ソフトウェアが融合したソリューションです。この共同開発ソリューションでは、エンタープライズグレードの信頼性と効率性のもとで、プロダクションモデルをカスタマイズ、管理、拡張できます。

多数の AI パートナーとの連携により、導入実現までのさまざまな選択肢を提供。

エキスパートとテクノロジーの集結によって、AI 活用の幅が広がっています。さまざまなテクノロジーパートナーが Red Hat と連携し、Red Hat ソリューションの運用能力に関する認定を受けています。

2025 年の Red Hat Summit および AnsibleFest で紹介されたお客様の AI 導入事例

ターキッシュ エアラインズは、組織全体でのデータアクセスを実現して、デプロイのスピードを倍増させました。

JCCM は、AI を使用して地域の環境影響評価 (EIA) プロセスを改善しました。

DenizBank は、市場投入時間を数日から数分へと短縮しました。

日立は、Red Hat OpenShift AI を使用して事業全体で AI を運用化しました。

信頼できる基盤の上で構築する

Red Hat の広範なポートフォリオは、ハイブリッドクラウド・インフラストラクチャ、アプリケーションサービス、クラウドネイティブ・アプリケーション開発、自動化ソリューションからなり、あらゆるインフラストラクチャで IT サービスを迅速かつコスト効率よく提供することができるという点で、世界中の企業に信頼されています。

その他の AI 関連資料

企業における AI の始め方

AI 向け Red Hat コンサルティングを利用する

Red Hat コンサルティング:AI プラットフォーム基盤

Red Hat AI について Red Hat に問い合わせる

1Forrester Consulting による調査 (Red Hat からの委託)、「Forrester Total Economic Impact™ Of Red Hat AI」、2026 年 2 月。